Мы публикуем стенограмму заседания экспертного семинара РВК, посвященного теме «Big Data – новые горизонты». Семинар является постоянно действующей площадкой для обсуждения вопросов, представляющих интерес для инновационного сообщества.

Игорь Рубенович Агамирзян: Мы рады вас приветствовать на нашем уже ставшем традиционным экспертном семинаре. В первый раз мы собираем его в нашем относительно новом офисе, мы сюда переехали в октябре. Надеемся, в дальнейшем будем проводить его более часто и на своей площадке. Я сегодня занимаю пассивную позицию, потому что самому интересно послушать. Тема в последнее время стала чрезвычайно популярной – по большим данным, по тому, как с ними эффективно работать и их использовать. У меня самого в данном случае ни опыта, ни личного мнения особого нет, хотя я знаю, что около 10 лет назад, когда уже стало можно обеспечивать доступ к большим массивам данных посредством интернета, это стало некоторым новым толчком для развития разных направлений, в том числе и в науке. Здесь я могу сослаться на мою любовь юности - астрономию. Астрономы в конце 90-х – начале 2000-х неожиданно обнаружили, что если просто сравнить накопленные в разных обсерваториях за один период знания, можно сделать новое открытие, не проводя других наблюдений. Это был неожиданный тренд, сегодня он становится все более общепринятым и для других научных направлений. Несомненно, он оказывается глубочайшее влияние на все направления технологического бизнеса. Его приложения с обработкой данных и коммуникацией стали абсолютно новой платформой во всех секторах, индустриях и научных направлениях. Сегодня с нами заместитель министра связи и массовых коммуникаций Марк Шмулевич, который как раз в министерстве возглавляет направление, связанное с информационными технологиями. Я на этом заканчиваю и хочу передать слово Марку, который спозиционирует наш разговор с точки зрения органов власти. Спасибо.

Марк Шмулевич: Спасибо большое, Игорь Рубенович. Во-первых, начну с комплимента вашему новому офису и очень красивому и светлому бизнес-центру, где я первый раз нахожусь. Во-вторых, действительно не секрет, что большие массивы данных – это одно из тех направлений IT, которое входит в одни из самых перспективных направлений развития. Фактически, перечни направлений, в которых раздел IT будет развиваться в ближайшие три-пять лет, различны в зависимости от того, кто их составляет. Но мы смотрим разные варианты, чтобы определить наши приоритеты в развитии. У меня есть личная история, начну с нее. Когда я занимался анализом данных в аспирантуре Физтеха лет 8 назад, это было интересное направление, не очень многие им занимались, но многие думали и говорили, что оно выстрелит. Прошло не так много лет, но уже нет никаких сомнений, что направление выстрелило, что количество применений данных растет экспоненциально - так же, как и количество неструктурированных данных, которые нужно обрабатывать. Если говорить о прикладной сфере, где большие массивы данных сейчас помогают, бывают совершенно неочевидные направления. Для меня, например, было неизвестно, что технологии анализа данных активно применяются полицией, и это, естественно, помогает при раскрытии преступлений. На Амазоне продается книжка под названием “Big data analysis for CEOs”, и несколько бизнес-школ рассматривают краткий курс техники анализа данных для менеджеров. Таким образом, big data сегодня – это не только область науки, но и очень быстро становящаяся частью нашей повседневной жизни область. Сейчас в Минкомсвязи России появилось отдельное направление, связанное с развитием отрасли информационных технологий, которой я и занимаюсь. Мы считаем, что развитие научных исследований в этой области – один из первых приоритетов. Так же, как и благоприятный налоговый режим для работы компаний в России, инвестиции в человеческий капитал. О науке ни в коем случае нельзя забывать. Мне будет очень интересно услышать ваше мнение про то, что сейчас происходит в России в области big data как в науке. Может, мы услышим что-нибудь в сегодняшних докладах. Но у нас было достаточно печальное ощущение, когда, стараясь понять, где находится сейчас Россия в области исследований computer science вообще, мы увидели, что в среднем ответ экспертов был такой: «в пятидесяти нет». И это беда. Мы всячески будем поддерживать, в первую очередь, исследования big data, поддерживать по-разному: популяризируя, какими-то финансовыми инструментами, грантами, когда это будет возможно. Сегодня это уже возможно - в рамках пока других программ. Мы надеемся, что, в частности, в области исследования больших данных в России скоро поменяется ситуация. Игорь Рубенович сказал про астрономию, я тоже хочу про нее сказать. Буквально сегодня смотрел некоторые новые данные. Например, если пойти на один из крупнейших сайтов, помогающих найти работу, и сравнить big data science и astronomy, мы увидим, что средняя начальная зарплата для PhD в астрономии $50000, а в data science - $100000. Количество открытых вакансий для астрономов – 335, а для data science – 140000. То есть я уверен, что в России пока такое время не пришло, но оно обязательно придет. Мне кажется правильным, что к этой теме приковывается достаточно большое внимание. Мы регулярно встречаемся с исследовательскими институтами и вузами, в которых проводятся исследования, обсуждаем и видим, что внимание растет и оно большое среди тех, кто начинает работать в этой среде сейчас. В конце выступления, наверное, покажу очень интересную картинку. Наличие такой книжки, наверное, тоже показывает, что big data быстро входит в нашу жизнь. Спасибо! И будет очень интересно послушать.

Леонид Жуков: Добрый день, я профессор Высшей школы экономики, также консультирую американские компании, занимаюсь вопросами больших данных. Во-первых, хочу сказать большое спасибо организаторам за то, что пригласили меня на этот семинар, и участникам за то, что пришли сюда послушать. Я очень рад, что тема вызвала такой большой интерес. На самом деле, она бескрайняя. Я попытаюсь осветить некоторые аспекты, поговорим об истории, откуда вообще возникла эта идея обработки больших данных, и это поможет нам понять, куда индустрия двигается. Я также постараюсь привести некоторые примеры компаний, понять, что они делают, посмотреть на основы технологий больших данных. У нас будет несколько технических слайдов. Дальше озвучу несколько мыслей по поводу того, куда вся эта индустрия будет двигаться. Если будут возникать вопросы по ходу рассказа, пожалуйста, прерывайте, пообсуждаем. Также хочу сказать, что как профессор я занимаюсь исследованиями в области больших данных, исследованиями в области машинного обучения. Мой предыдущий опыт стартапера позволяет мне на это смотреть с точки зрения потребителя больших данных. В отличие от моих замечательных коллег-докладчиков, я не произвожу системы больших данных, я использую эти системы для своей работы. Поэтому мой взгляд на эту проблему будет со стороны пользователя.

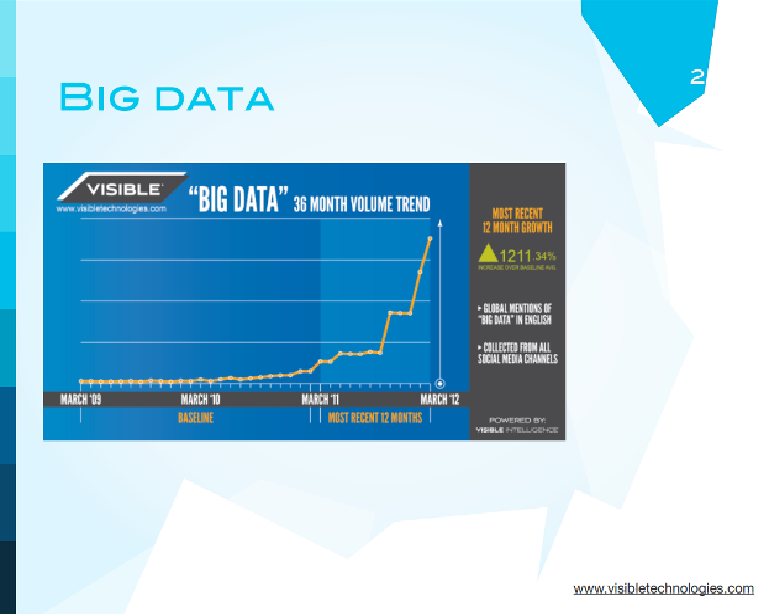

Вообще говоря, впервые термин больших данных появился в начале 2009 года, а дальше, если вы обратите внимание, начался экспоненциальный рост где-то весной 2011 года. Это связано не только с тем, что технология стала более популярной, но и с достаточно прозаическим фактом.

McKinsey опубликовала ставший знаменитым отчет о том, что big data – следующий шаг для инноваций, соревнований и повышения производительности. Они написали о том, что Facebook обрабатывает порядка 30 миллиардов элементов контента каждый месяц, Конгресс США обрабатывает порядка 240 терабайтов данных каждый месяц. Также они сделали оценку этого рынка, и именно эти данные заставили людей посмотреть внимательно на отчет. На самом деле, эта тема была, конечно, создана в какой-то момент McKinsey.

После публикации этого отчета об этом заговорила вся пресса. Все пишут о big data, о том, как это можно использовать, о том, что это будет революция. Не только термин big data, но и другие термины стали теперь популярными. Например, data driven business – и любой бизнес хочет стать именно таким. Под этим понимается, что любой бизнес хочет принимать решения, основываясь не на интуиции исполнительного директора, а на данных, которые он получает. Также появился очень популярный термин «демократизация данных». Здесь идея заключается в том, что не только аналитики и инженеры должны иметь возможность смотреть на данные, но и любой бизнес-персонал компании.

Белый Дом не остался в стороне от этого тренда, и в 2012 году они объявили инициативу: предложили всем подразделениям создать конкурсы, на которые следует пригласить людей для работы над большими данными. Это оказалось очень важным для страны.

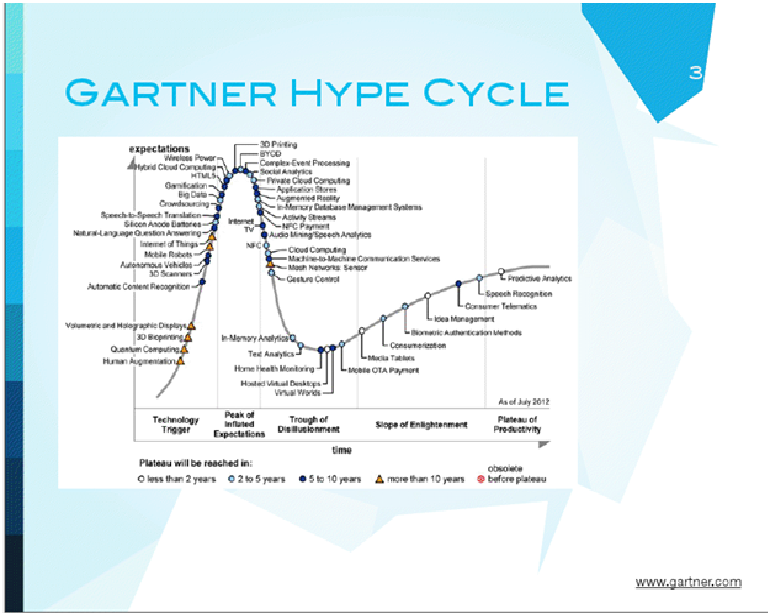

Если мы посмотрим на знаменитый цикл инноваций, который делает Gartner, то мы увидим, что big data, которая указана на этом цикле, двигается к своему пику популярности. Надо заметить, что после него обычно происходит спад, а потом, если технология хорошая, она выходит на стандартный рабочий уровень. Сейчас этот цикл написан для 2012 года, мы двигаемся на самый верх. Тема очень популярная.

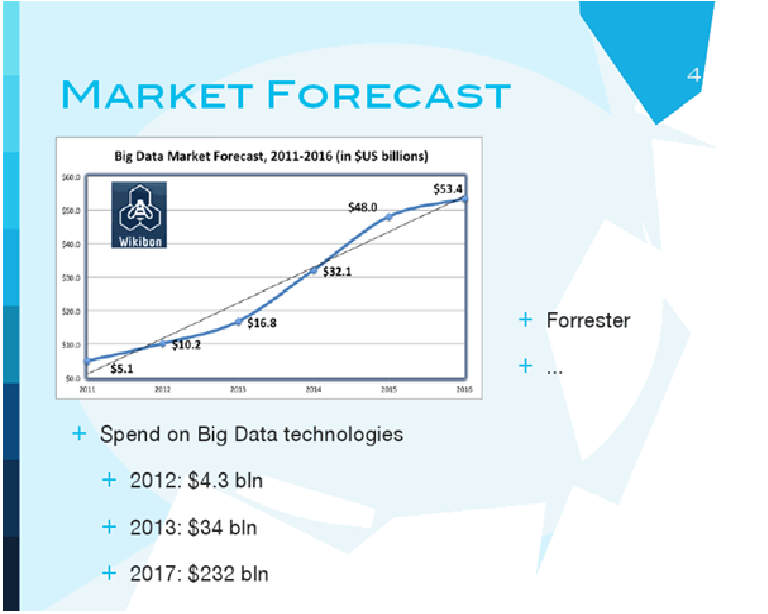

Все это, конечно, привело к фантастическим оценкам будущего этого рынка. Одно из самых скромных предсказаний – к 2016 году рынок составит порядка 53 миллиардов долларов. Есть и большие оценки – к 2017-2018 годам будет порядка 200 миллиардов долларов. Венчурные капиталисты не ждут, а вкладываются в стартапы, в которых есть слова big data. В 2009 году было примерно 1,1 миллиард вложено, в 2011 – уже 2,5 миллиарда., в 2012 уже порядка 4 миллиардов долларов венчурных денег было вложено в стартапы, которые занимаются обработкой и анализом больших данных.

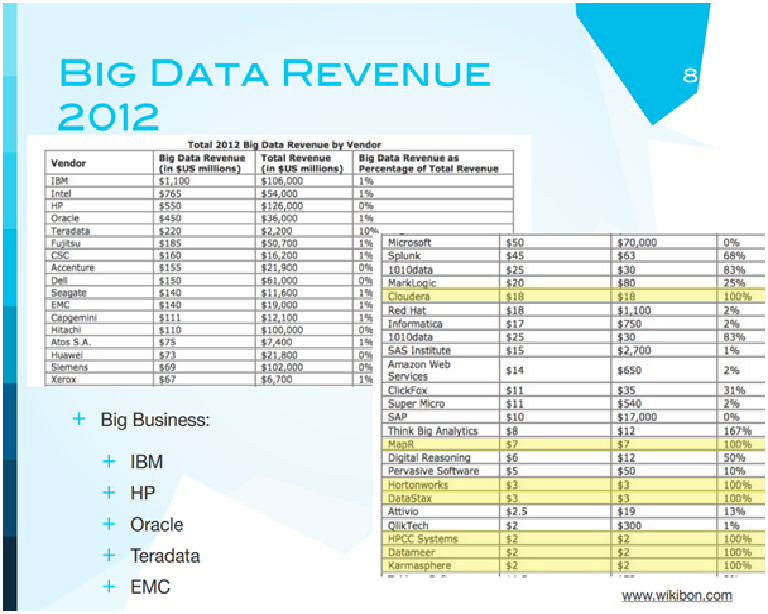

Однако, большие данные – это не только будущее, но и настоящее. Здесь, в этой таблице, собраны данные по компаниям за 2012 год, которые тем или иным образом связаны с большими данными. Наибольшие доходы, конечно, у IBM, HP, Oracle, Microsoft, и это, естественно, связано с тем, что в больших компаниях большой бизнес, они занимаются хранением и обработкой больших данных. Но более интересно посмотреть сюда. Процент от полного дохода, получаемого от big data, у IBM, например, только 1%. То есть для рынка это большой доход, а для компании – очень маленький.

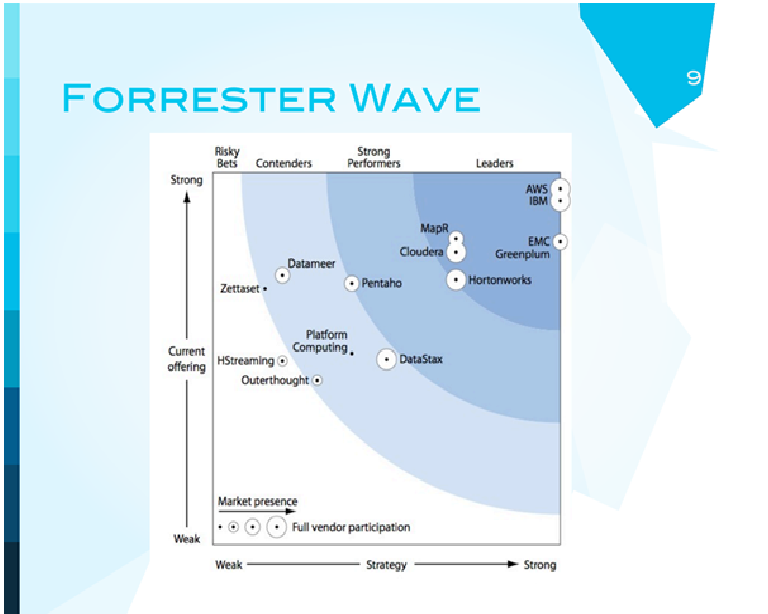

Сегодня я постараюсь говорить о компаниях, в которых 100% дохода – big data, это стартапы. Мы поговорим о том, что они делают. Нельзя говорить о ситуации в бизнесе, не показав Forrester Wave. По осям у нас показано то, насколько сильные стратегии игроков, вертикальная ось – нынешнее предложение. В самом углу мы видим как сильнейших игроков MC, IBM, и они там не случайно. Есть еще и Amazon Web Services. Нас будут интересовать эти три компании сегодня в первую очередь. Почему? Эти компании распространяют технологию Hadoop – ту технологию, которая используется для обработки больших данных. Эти компании делают и предоставляют надстройки над Hadoop, дополнительные сервисы, аналитику, визуализацию – следующий шаг.

Прежде чем говорить о big data, надо разобраться в том, что же это значит. McKinsey сами по себе дают следующее определение: Big data – данные, которые вы не можете обработать традиционными средствами. Есть другое определение, которое говорит о том, что это феномен, определяющийся быстрым, ускоряющимся развитием, расширяющимся объемом данных и их сложностью. Мне, честно говоря, наиболее близко третье определение. Big data – коллекция инструментов и технологий, которая позволяет продуктивно работать с данными независимо от масштаба этих данных. Есть еще и четвертое определение: “три V”: volume – данные уже обладают объемом, variety – представлены данные самого разного типа, velocity – скорость, с которой приходят данные. Ясно, что для того, чтобы работать с большими данными, требуется их распределенная обработка, и в принципе, большие данные – это, с одной стороны, хранение данных, с другой стороны, их обработка, причем желательно все это вместе. Существует такое мнение: когда говорят о больших данных, говорят о Hadoop. Это не единственная технология, существуют более традиционные технологии, которые сейчас масштабируются. Но тем не менее, если рисовать картинку, есть пересечение big data, большой темы, есть Hadoop, технология, которая позволяет производить вычисления, и cloud computing. Big data и cloud computing – это не одно и то же, это разные вещи.

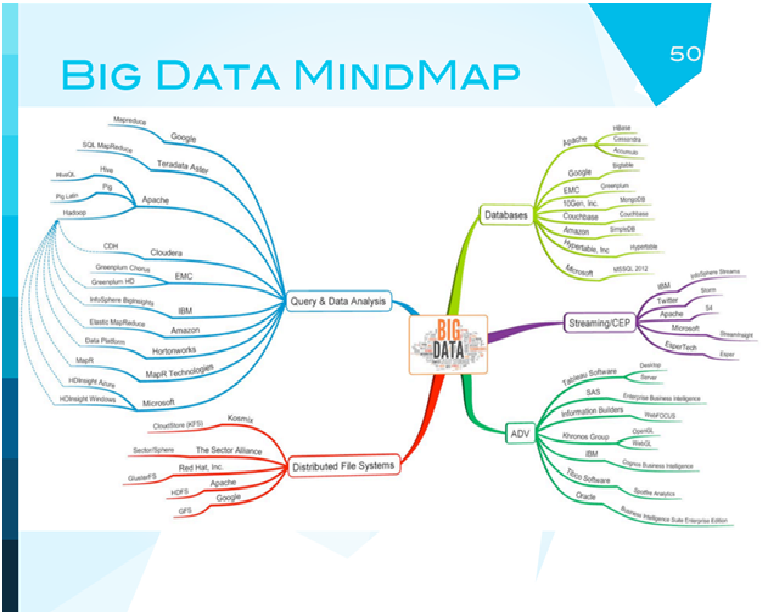

Давайте посмотрим на эту картинку просто ради интереса. Кто знает все слова, которые здесь написаны? Вы знаете? Ребята, вы инженеры. Кто знает половину слов? Это нормально. Когда создается новая индустрия, что делают люди? В первую очередь, изобретают свой сленг, свою терминологию, которую будут использовать. Это терминология, которая используется сейчас в big data, человеку непосвященному, со стороны, она вообще ничего не скажет. Это происходит потому, что это названия самых разных продуктов, которые используются в системах обработки данных. Почему они так странно названы? Половина из них создана стартаперами, другая половина создана в больших компаниях, которые представляют себя стартаперами. Я очень надеюсь, что к концу лекции некоторые названия для вас будут хоть что-то значить.

Что такое вообще big data, насколько она большая? Google обычно очень скромничает и не показывает свои цифры, но говорят, что он обычно обрабатывает около 24 петабайт данных в сутки. Твиттер – порядка 7 терабайт данных добавляется каждый день в хранилище. На Facebook 12 терабайтов контента каждый день. Именно это и есть масштабы, о которых идет речь. На самом деле, работать с большими данными и обрабатывать их люди начали очень давно. Если вспомнить, начиная с 60-х годов существовала тема под названием «суперкомпьютеры», в нее вкладывались большие деньги. Национальные лаборатории, университеты. Единственное, что задачи были немного другие. Как правило, на суперкомпьютерах обсчитывались не большие данные, а сложные вычислительные задания, когда требовалась большая мощность процессора. Но также могли и считаться большие модели с данными.

Почему суперкомпьютеры не пошли в индустрию? Все очень просто. Потому что они очень дорогие. В середине 90-х годов поток денег на суперкомпьютеры стал уменьшаться, и ученые в лабораториях решили обойтись без суперкомпьютеров, но иметь возможность справляться с большими и трудными задачами. Тогда возникла идея о кластере из большого количества маленьких компьютеров, соединенных обычной технологией, использующих ту же самую парадигму программирования, как и суперкомпьютеры. Дешево и сердито. Проблема следующая: как только вы соединяете много дешевых компьютеров, вероятность поломки одного из тысячи компьютеров очень высока. Поэтому такие системы, несмотря на их дешевизну, оказалось почти невозможно использовать.

2000-е годы – новая реальность – появляются большие компании, появляется Yahoo, Google, компании, которые работают на потребителя, собирают информацию со всего интернета, огромные количества данных. Они хотят зарабатывать деньги рекламой, они должны обрабатывать e-мейлы, e-commerce – куча всяких предпосылок. Понятно, что в то время эти компании пока еще не могут позволить себе суперкомпьютеры. Например, сейчас Google может себе позволить суперкомпьютеры, а тогда не мог. Тогда все говорили о commodity hardware – обычных дешевых pc, о том, как можно обработать огромные объемы данных на маленьких pc. Опыт суперкомпьютеров не подходил, просто потому что pc ненадежны. Google озадачился этим вопросом в 2000 году, создал у себя систему. И на удивление людям в 2003-2004 году вышли две статьи, которые перевернули все понимание.

Одна статья была о файловой системе, которая используется внутри Google, а другая статья предлагала технологии для обработки данных. Эти две статьи положили начало современной технологии обработки больших данных.

Следующие 2-3 слайда будут техническими, я постараюсь руками объяснить, что происходит, если получится, будет хорошо.

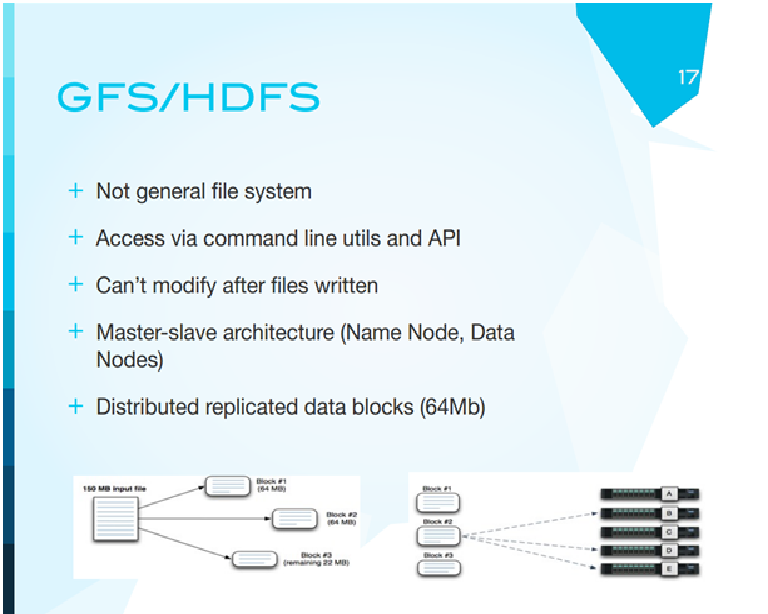

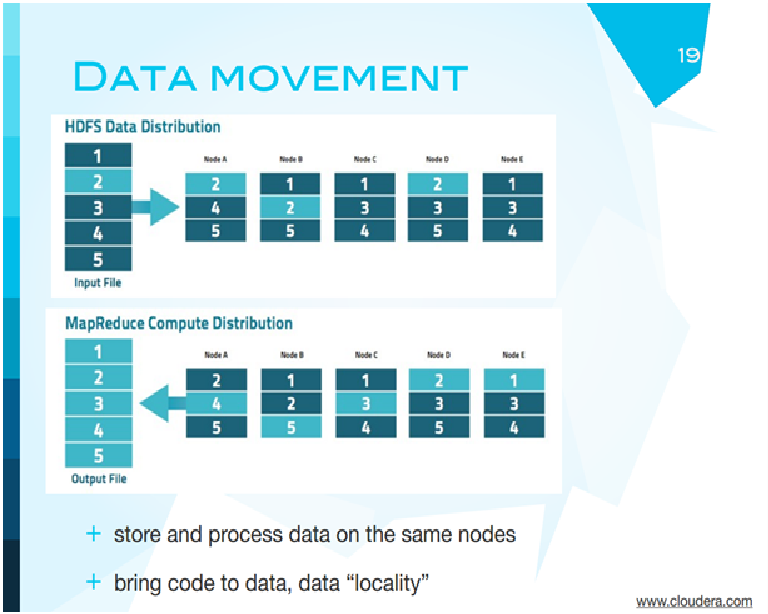

Из-за того, что наши компьютерные системы ненадежные, часто выходят из строя, как бы нам сделать так, чтобы поломка одного компьютера не мешала вычислениям? Идея была следующая: не хранить файлы на каждом компьютере. Взять файлы, разбить их на маленькие кусочки, сами кусочки разбросать по разным компьютерам с дублированием. Таким образом, что если компьютер, на котором находится обрабатываемый кусочек данных, вышел из строя, ничего страшного не произойдет, копия этих данных лежит на другой машине. И будет некий мастер-сервер, который будет говорить о том, где и что находится. Это была первая идея надежной распределенной файловой системы Google.

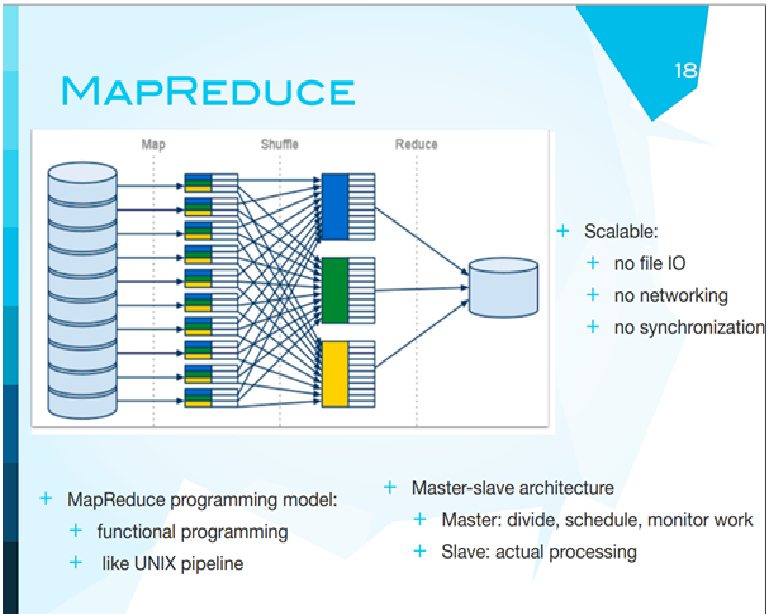

Вторая идея – map reduce, здесь идея следующая. Она хорошо работает, если к разным кускам данных можно применять одни и те же процедуры. Вам нужно посчитать, сколько раз каждое слово встречается в книге. Что можно сделать? Можно разбить эту книгу на главы, раздать эти главы на разные компьютеры. Каждый из них независимо будет считать количество определенных слов в своей главе, а в самом конце мы просто сложим эти числа. Таким образом, получится следующее: если один из компьютеров в процессе сломается и не сможет вычислить эти количества, ничего страшного. Мы просто запустим еще один с таким же кусочком работы. Самое главное, что работа всех остальных компьютеров не пропадет. Это идея map reduce. На самом деле, это очень большое упрощение по сравнению с тем, как все делалось на суперкомпьютерах. Упрощение связано с тем, что данные разбиваются на кусочки, каждый кусочек отправляется на отдельный компьютер на обработку, дальше данные собираются вместе, выводится результат.

Трюк заключается в том, что для суперкомпьютеров, для многих расчетов, например, ядерного взрыва или решения дифференциальных уравнений, эти машины должны друг с другом общаться. Если нет коммуникации, в суперкомпьютерах это называется простое параллельное программирование. Ученым это было неинтересно. Однако для бизнеса эта модель оказалась именно той, которая была нужна.

Еще раз повторюсь, чтобы было. Этот слайд очень хорошо иллюстрирует всю информацию. Представьте, что у вас есть некоторый файл с данными. Этот файл разбивается на 5 частей, эти части раздаются различным компьютерам с повторением. Дальше каждый из компьютеров выполняет обработку на конкретном данном ему участке, и результат передается обратно. Это и есть вся идея map reduce. Что случится, если умрет этот компьютер? Он работал над первой частью. Первая есть еще здесь и здесь. Когда этот второй компьютер закончит свою работу, он сможет обработать эту оставшуюся первую часть.

Важным моментом является то, что вместо того, чтобы посылать данные на компьютер, они принесли сами процессоры к данным. Данные изначально распределены, и дальше работа происходит на каждом участке отдельно. Это все насчет технологий. Я надеюсь, что это дает представление о том, какая технология лежит в основе всей системы.

Дальше события развивались очень интересным образом. Дак Каттинг, человек-оркестр, был консультантом, работал сам по себе, немного в Yahoo, занимался тем, что сам по себе писал поисковый движок. Каким-то образом он стал сотрудничать с Yahoo и решил, что надо написать еще и кроллер, систему поиска по web. Он большой поборник открытых кодов, поэтому все это был открытый код. Дальше в 2004 году ему попалась на глаза статья, написанная в Google. Он собственноручно написал Hadoop, имплементировал полностью всю систему. Hadoop, между прочим, - это имя этого слоненка, а слоненок – игрушка его ребенка. Эта система была названа так исторически, и дальше разные программные продукты люди стали называть разными именами. Например, zoo keeper – система, которая заставляет многие из этих продуктов работать вместе. То есть, фактически, Дак Каттинг – отец-основатель Hadoop.

Сейчас Hadoop, например, в Yahoo – это 40000 серверов, 170 петабайт хранилища. Там больше 100000 пользователей. Используется для фильтрации спама, категоризации, рекламы, для чего угодно.

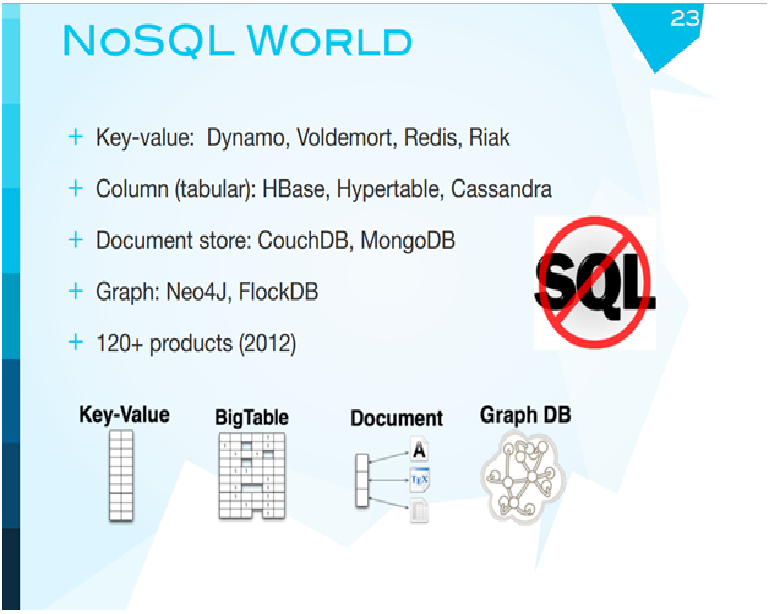

Еще одно техническое замечание, как я и обещал, - революция так называемая NoSQL. SQL – стандартные базы данных в таблицах, к которым мы привыкли. Проблема в том, что это таблички, и когда таких данных много, и они взаимосвязаны, работать с ними тяжело. В табличку писать медленно, довольно сложно заставить ее работать с большим числом пользователей одновременно. Поэтому было предложено пожертвовать некоторыми свойствами настоящих баз данных, фактически хранить данные как простые файлы без всякой схемы.

NoSQL world – это теперь тоже большой зоопарк типов баз данных. Можно хранить как ключ и значение, как обыкновенную табличку, просто как документы, и новые графические базы данных, если вы хотите сохранить графы. Идея очень простая: уйти от баз данных, которые умеют все, но медленно и дорого, к чему-нибудь, что очень специализировано, заточено под конкретную задачу, но летает.

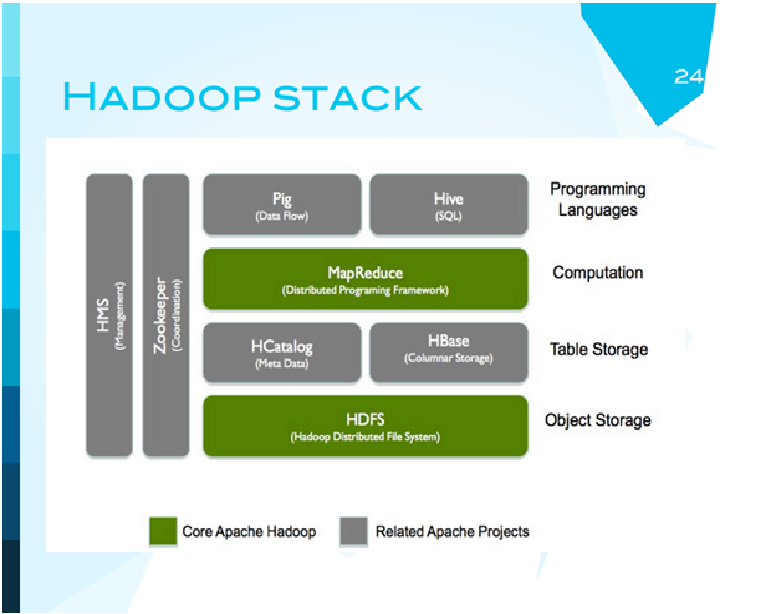

Hadoop теперь – это целый набор систем. Есть HDFS – Hadoop - файловая система, ее основание. Сверху на нее ставятся разные базы данных, причем базы как раз NoSQL, еще выше - система программирования map reduce. И сверху нее некоторые надстройки, которые позволяют людям-не-программистам работать с этой системой. Например, PIG. PIG – высокоуровневый скриптовый язык, который можно скомпилировать и превратить в MapReduced. Хайв – некоторая симуляция работы с обычными базами данных, которая также превращается в map reduced jobs. Это означает, что теперь аналитики в принципе могут пользоваться хайвом, для них это будет выглядеть более или менее как работа с обычной базой данных. Но внизу будет современная распределенная технология.

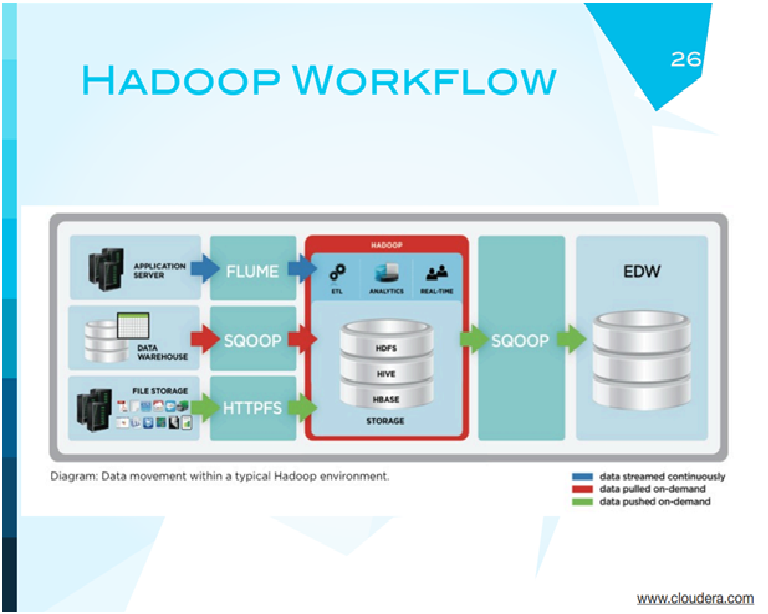

Типичный поток обработки информации на Hadoop выглядит следующим образом. Данные могут быть на каком-то сервере приложений, на классическом стандартном хранилище, и есть системы, которые позволяют перенести их в Hadoop. В Hadoop они могут обрабатываться, храниться и экспортироваться в обычные базы данных.

Для чего используется Hadoop сейчас? Для решения многих задач. Например, для нахождения и обработки текстов, создания рекомендательных систем коллаборативной фильтрации, предсказательных моделей, оценок риска, нахождения элементов в тексте, предсказания прихода/ухода клиентов, сегментации клиентов, многого другого. Все эти задачи легко разбиваемы на отдельные кусочки. Именно такие задачи прекрасно подходят для Hadoop.

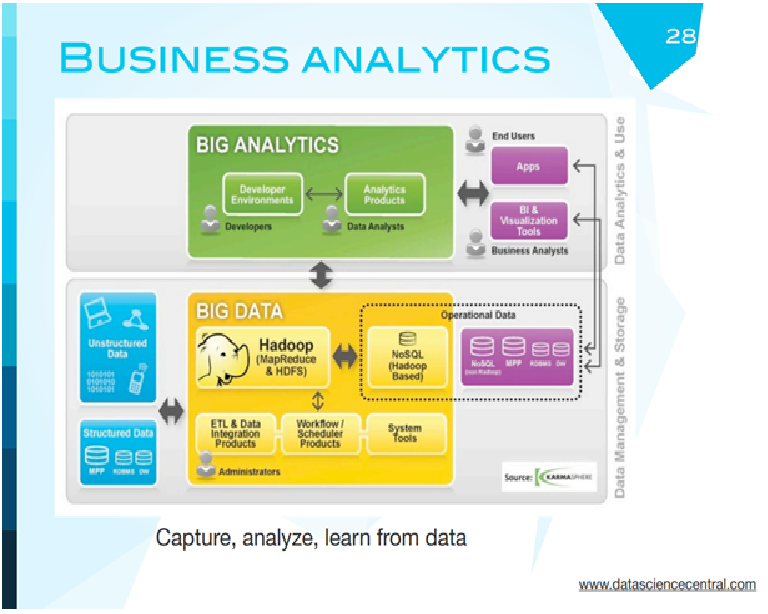

Если мы говорим о работе бизнес-аналитика, то примерная схема предприятия для перехода на работу с большими данными выглядит вот так: это новая часть, в ней появился Hadoop, дополнительные системы обработки данных. Но они связаны со стандартными классическими базами данных. Hadoop ни в коем случае не заменяет операционные традиционные базы данных, это дополнение расширяет ваши возможности. И удешевляет, потому что не все данные вечно можно хранить в Oracle, учитывая то, сколько он стоит.

Кто сейчас использует Hadoop? Это просто небольшой скриншот компаний, которые его используют. Это сейчас менйстрим. Групон, Nokia, все названия знакомы. Это только те, кто официально заявляет, что используют Hadoop. Техническая часть закончилась.

Теперь немного про бизнес вокруг Hadoop. Hadoop – это открытый продукт, и вы можете его взять и установить, так же как и linux. Проблема такая же, как и с linux. Предприятия просто не хотят брать какой-то продукт и устанавливать его, потому что это сделать сложно, они хотят поддержку, потому что они хотят гарантии качества. На этом построен бизнес Red Head.

Cloud Era, одна из первых компаний, которая поняла, что здесь кроется большой бизнес, была основана в 2008 году. На сегодняшний день у нее 140 миллионов венчурных денег. Ее сейчас оценивают довольно скромно, порядка нескольких миллиардов, там работает около 200 человек. Они поставляют Hadoop как продукт, предоставляют обслуживание, консультации и обучение. Также они стараются развивать, делать надстройки на Hadoop.

Следующая компания, которая так же построена на Hadoop, - это MapR Technologies, основаны на год позже. Гораздо меньше финансирования, гораздо меньше клиентов, но они решили немного изменить технологии, которые лежат в основе Hadoopа, и пойти по другому немного пути. При этом они решили не делать их открытыми. К этой компании отношение на рынке очень интересное, потому что, с одной стороны, они вроде как делают что-то любопытное, а, с другой стороны, всем нравится, все поддерживают Open source. Запирать компанию на какую-то отдельную технологию нельзя, потому что если устанавливающая компания умрет, кто будет поддерживать эту технологию? Поэтому все стараются смотреть на Open source.

Третья компания, Hortonworks, организована только сейчас. На самом деле, довольно поучительная история. Hadoop развился вокруг Yahoo. Yahoo сделала spin-off Hadoop как отдельную компанию спустя 6-7 лет. Не очень понятно, о чем они думали. Теперь это последний участник игры в коммерциализацию Hadoop.

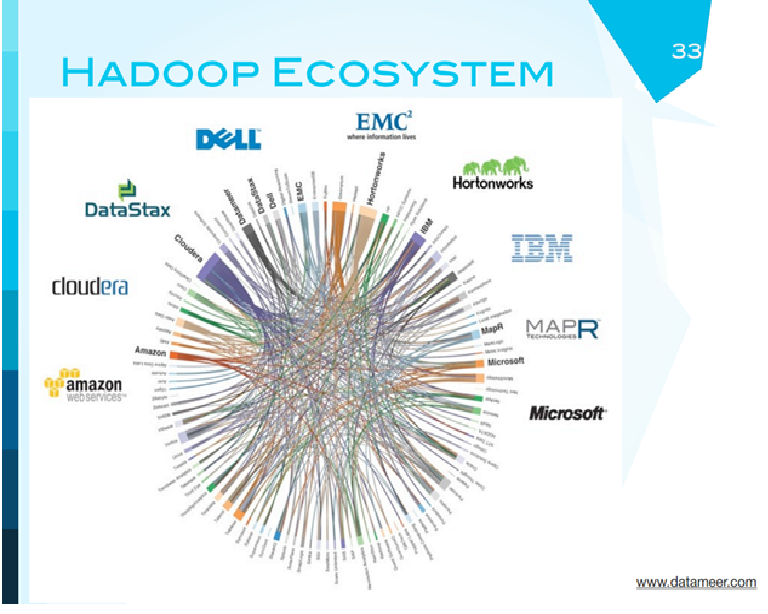

Это экосистема Hadoop. Экосистема в том смысле, что это компании, как они между собой связаны, какими контрактными отношениями, и поставщики Hadoop. Есть Cloudera, Horton works, Web-Art. А как участвуют в этом мире IBM и MC, думаю, расскажут вам потом. Обратите внимание, что Cloudera здесь, действительно, - самый мощный участник.

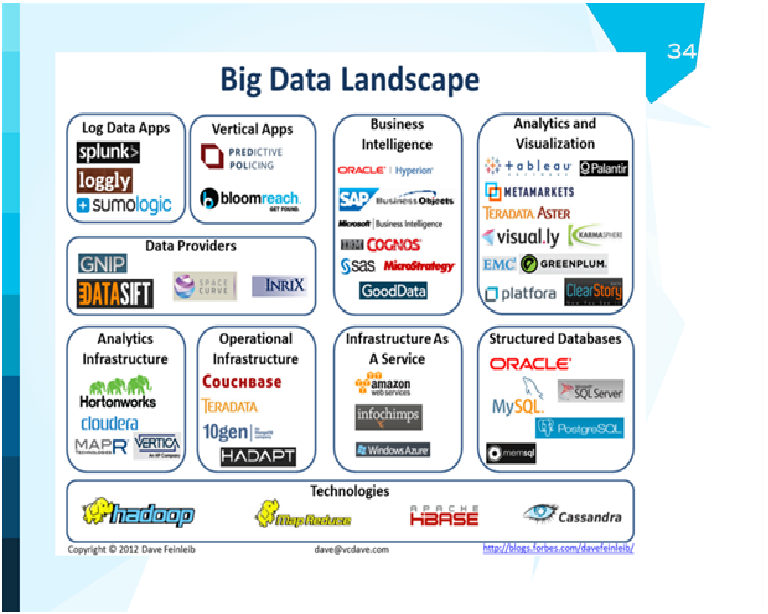

Мы с вами немного поговорили про эти компании, мы знаем, что такое Hadoop, map reduce, даже видели вот такие названия. Сейчас мы с вами просто посмотрим примеры компаний из разных квадратиков: бизнес-интеллигенция, аналитика, визуализация.

Компания Splunk – выдающаяся компания, на самом деле. Основана в 2003 году, занимается совершенно занудным делом – копается в логах, где что сломалось. Они вовремя поняли, что технология, которую они разрабатывают, должна быть масштабной, и подключились к big data. С тех пор они подняли 230 миллионов, сделали IPO, сейчас на рынке оцениваются в 3,5 миллиарда. Что они делают? Они обрабатывают машинные логи, распределенные определенным способом. Они могут подключиться к системе, проанализировать логи, выдать вам результат и сказать, что сломалось. Простая идея, простая модель – 3,5 миллиарда. Это b2b.

Следующая компания - Datameer. Довольно свежая, 2009 год, 17 миллионов – фандинг. Они работают уже с надстройкой над Hadoop. После того, как у нас уже есть Hadoop, мы умеем хранить и обсчитывать данные, знаем, как поместить и изъять оттуда данные, неплохо бы сделать какую-то аналитику на этих данных и нарисовать эти данные. Этим занимается Datameer. У них есть довольно интересная технология, по которой они берут небольшой отрывок данных из Hadoop, обрабатывают его, после этого позволяют работать с ним как с обычной таблицей Excel.

Datasift– другая интересная компания. Ее идея заключается в том, что всем нужны данные. Давайте станем центральной точкой сбора данных и будем эти данные перепродавать. Основана в 2008 году, называют себя data-платформой для social-web, фандинг около 60 миллионов, данные получают от социальных сетей, твиттера и других.

Infochimps - опять-таки, 2009 год, фандинг очень небольшой. Эти ребята несколько раз меняли свою стратегию. Cейчас они себя представляют как n2n провайдер для больших данных. Если у вас есть большие данные, вы в этом ничего не понимаете, но знаете, что рынок требует работы с большими данными, они придут, поставят Hadoop, научат им пользоваться.

Tableau Software – очень старая компания, 2003 года, с очень небольшим финансированием, долго ходили по рынку, нашли для себя интересное положение – визуализация и анализ данных.

Что касается новых, молодых компаний. Platfora – бизнес-аналитика на ходу, Sumologic – пытаются повторить успех Splunk’а и сделать анализ логов. Hadapt – некая компания, которая пытается совместить Hadoop и реляционные базы данных. Metamarkets – эти ребята понимают, что у многих компаний есть проблемы с потоками данных, они разрабатывают технологии нахождения паттернов в потоках данных. DataStux сосредоточены на консультации и обучении, Karmasphere – аналитика. Вот несколько компаний для 2013 года. 10gen разрабатывает NoSQL базу данных, она не Hadoop-овская, отдельная. ClearStory– аналитика, Continuuity – Hadoop и API, ParStream – аналитика баз данных. Climate corporation – единственная из компаний, которая имеет прикладной характер. Если вы обратите внимание, на этом слайде в основном все компании занимаются анализом и визуализацией данных.

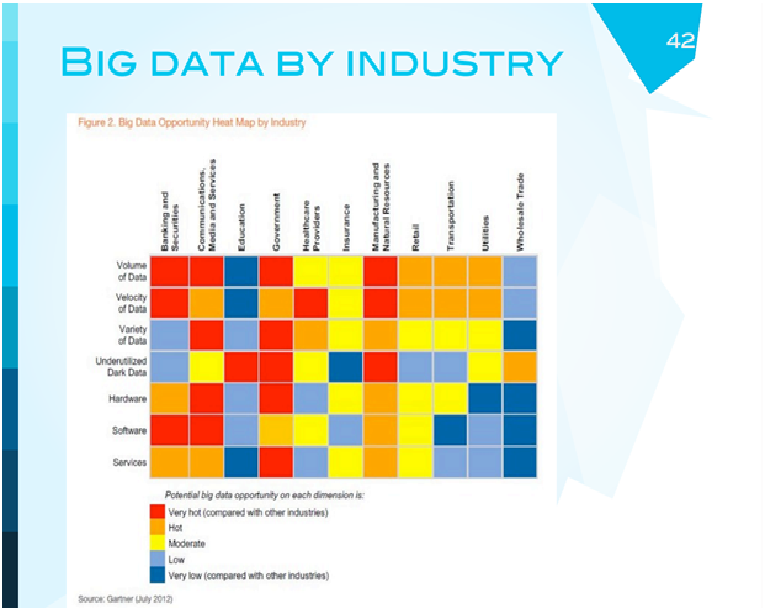

Возвращаемся к Гартнеру - это Heat Map, которая показывает, в каких областях индустрии big data сегодня интересна. Банковские сервисы, правительства, коммуникации, производство. Я немного не согласен с health care providers, потому что есть ощущение, что health care – это та область, где большие данные хорошо пойдут скоро. Я подозреваю, что выделено здесь это таким цветом потому, что в Америке очень сильно зарегулировано, не так просто пробиться в нее, нужна куча разрешений, чтобы хоть что-нибудь делать с медицинскими записями.

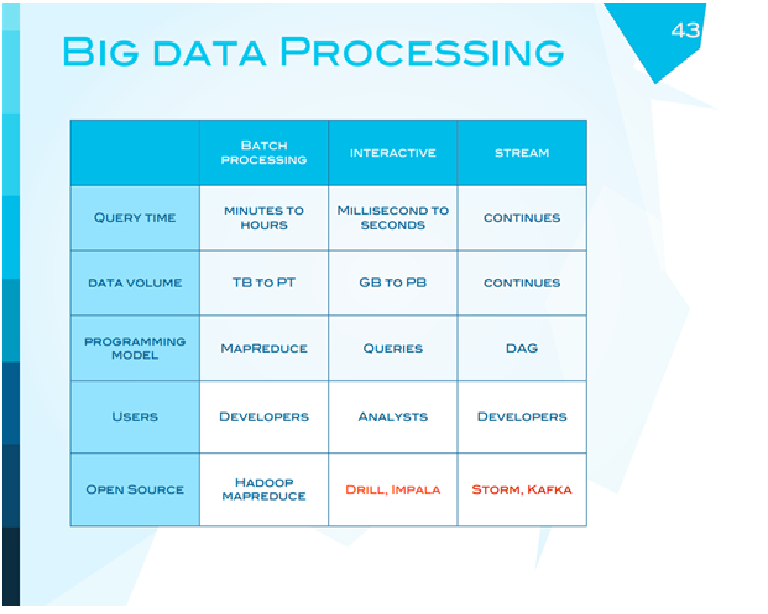

Чтобы перейти к будущему, я хочу показать сводную табличку, где обозначено, что технология map reduce предназначена для обработки данных партиями, это не интерактивная система. Для аналитиков, как правило, требуется интерактивная работа. Hadoop этого сделать не может, в Hadoop обработка должна происходить офф-лайн, как раньше суперкомпьютеры – поставили в очередь работу, утром вернулись и получили результат. Этим самым открывается возможность для разработки новых продуктов, которые могли бы работать на больших данных и быть интерактивными. В точности так же Hadoop не может работать с потоками данных.

И здесь есть возможность для разработки новых продуктов. То, что здесь показано, – новые продукты в разработке, они тоже сейчас делаются как open source, которые отвечают интерактивной системе взаимодействия с большими данными и обработке потоков.

Я особо много говорить о них не буду, но стоит заметить, что Storm (система для обработки потоков), пионер этой разработки - никто иной как твиттер, это просто их внутренняя разработка, которую они решили открыть людям. Kafka, система анализа сообщений, разработка Linkedin.

Систему работы с real time запросами очень сильно разрабатывает сейчас Cloudera в качестве дифференциатора на рынке: не просто поставлять Hadoop, но и в качестве надстройки что-то свое и интересное.

Нельзя оставить без внимания важную часть машинного обучения. К сожалению, сейчас это самое слабое место во всей системе больших данных. Мы умеем хранить данные, обрабатывать их и решать простые задачи. Писать сложные вычислительные алгоритмы, которые действительно будут делать предсказания или еще что-то, очень сложно, и для этого фактически нет технологий. Mahout – библиотека, которая сделана для работы на Hadoop, очень примитивная, и пока никто не взялся ее оттачивать. R, как язык статистического программирования, сейчас де-факто стандарт в обработке больших данных, но он нераспределенный. На самом деле, если есть место для инноваций достаточно большое, это как раз в области машинного обучения для больших данных.

Откуда пришли технологии. Гуглфайлы пришли из Google, Hadoop - из Yahoo, амазон предложил свои базы данных, Facebook предложил базы данных cassandra, HBase, твиттер – систему Storm, linkedin – еще несколько технологий.

Заканчивая, я хотел бы сказать следующее. Несколько наблюдений об эволюции технологий больших данных. Мне не хочется признавать как стартаперу, но, похоже, технологии, которые фундаментально изменяют ход дел, приходят из больших компаний. Потому что там есть ресурсы и люди, которые могут думать не только о сегодняшнем, но и завтрашнем дне. Во-вторых - очень важный момент! - эти технологии были почти что сразу сделаны open source. Их открыли для бесплатного пользования, создалось сообщество, и люди смогли туда вкладывать больше энергии и популяризовать их. Сразу же вокруг этих open source’ов возникли стартапы, которые начали их использовать разными способами. Последнее философское замечание - о том, что, на самом деле, это все компромисс, потому что ничего нового не изобретено. Просто взяли модель суперкомпьютера - и отказались от условий. Взяли модель базы данных - и упростили ее, сделали более приемлемой для бизнеса.

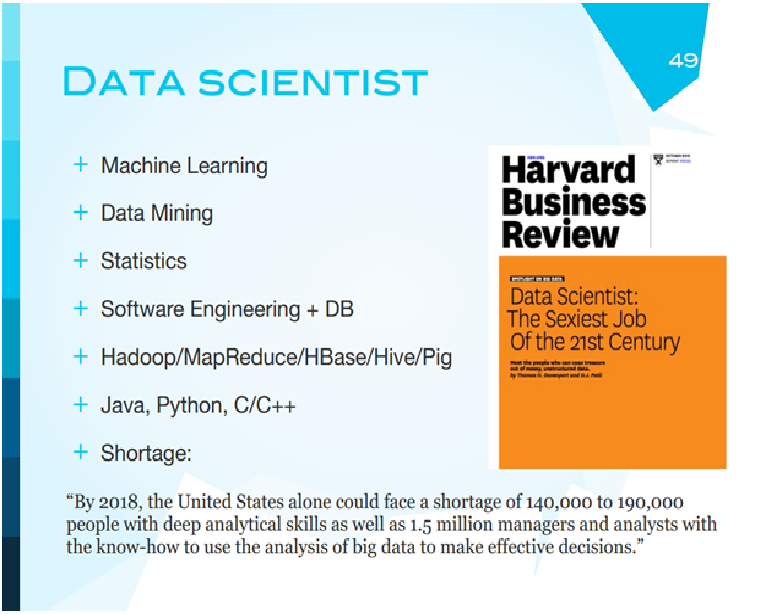

Тот же Gartner сказал, что в 2018 году в США будет нехватка 190000 специалистов со знаниями data analysis, data science. Что такое data scientist? Люди, которые понимают машинное обучение, которые знают, как анализировать данные, знают статистику, обладают навыками программиста, знают технологии. Главное, что этому научить не так сложно. Для людей с таким образованием научиться вот этому будет гораздо проще, чем этому.

Последний слайд. Мне, честно говоря, он очень понравился. Безумный слайд с mind map. Он показывает несколько основных направлений big data, и дальше компании и технологии, которые они создали. Для того чтобы осознать весь этот зоопарк, который творится в больших данных, будет очень полезна именно такая карта.

Игорь Рубенович Агамирзян: Спасибо большое. Мне было очень интересно, несмотря на то, что я знал некоторые слова вроде map reduce из тех времен старых, когда еще занимался этим. Но много и чрезвычайно новой для меня информации. Надеюсь, что слушателям тоже было интересно и полезно. У нас сейчас предусмотрено два содоклада от представителей ведущих компаний, но так как было достаточно много содержательной информации, я могу предложить задать сейчас несколько вопросов, если есть животрепещущие. А потом, уже после выступлений представителей MC и IBM, сделаем дискуссию.

Александр Брызгалов: Короткий вопрос. На последнем слайде российских компаний совсем нет. Кто здесь у нас этим занимается?

Леонид Жуков: На самом деле, у нас есть Yandex, mail.ru и еще пара компаний, в которых используется Hadoop или технологии, похожие на Hadoop. У нас есть технологии, которые, по всей видимости, лучше, чем Hadoop, но они закрытые. Мы идем своим путем. Кстати, судя по результатам поиска Yandex’а, неплохой путь.

Ростислав Яворский: Можно уточняющий вопрос? По картинке, как выглядит рабочее место аналитика.

Леонид Жуков: Идея такая. Появился слон в посудной лавке. У нас данные могут быть известны заранее, собраны и структурированы, какие-то - нет, просто поступили к вам в компанию. Раньше, когда этой части не было, они все уходили в стандартные базы данных и хранилища. Теперь здесь у нас появился Hadoop. Во-первых, нам нужно нормализовать данные и поставить их в Hadoop. В Hadoop данные можно хранить и использовать для обработки, и это намного дешевле, это сейчас стараются делать компании. Аналитик может работать с Hadoop напрямую. Также есть связь между application и users. Если вы пользователь, вы пришли, предположим, для вас есть рекомендации, просчитанные на Hadoop с использованием данных. Вы их получаете, когда заходите на сайт. Это общая картина среднестатистического бизнеса, связанного с данными. Что насчет компаний, есть группа компаний, которые занимаются аналитикой и визуализацией. Кстати, очень интересная компания Палантин, занимается анализом больших данных, финансируется из CIA фонда. Эта коробочка – классические базы данных. Business intelligence – более или менее понятно, datacif – то, что мы обсудили, это агрегаторы и перепродавцы данных. Splunk, Logdata, Applications – те, которые анализируют логи. А эти ребята, честно говоря, не помню, что делают. Vertical applications – видимо, для какого-то сегмента рынка. Operation infrastructure – классические базы данных, которые используются в ежедневной работе компаний.

Вопрос из зала: Я так понял, что в области бизнеса будет стимул, экономическое преимущество у компаний, которые занимаются big data, по сравнению с другими компаниями. Это заставит рынок вести компании к большему использованию таких технологий. Относительно государства. Что может заставить государство заинтересоваться этими технологиями и прибегнуть к их использованию?

Леонид Жуков: Вы знаете, государство – это тоже в некотором смысле бизнес. Ясно, что стоимость хранения данных в Hadoop раз в 10, а, может быть, и в 20 дешевле, чем в базах данных Oracle, и это довольно существенная разница. Если мы сейчас пытаемся сделать электронное правительство и собрать все данные воедино, организовать систему документооборота и оборота данных, их надо где-то хранить. Можно заплатить Oracle или EMC, а можно сделать Hadoop. Hadoop позволяет обрабатывать данные. Если вы хотите найти какие-то закономерности в данных.

Александр Московский: Все-таки по поводу генеалогии, происхождения. Мне кажется, что в научном мире был ряд проектов - национальные лаборатории, академические исследования, - которые как раз больше ложатся в эту тему big data, они как-то не получили вашего внимания.

Леонид Жуков: Я полностью с вами согласен, но рассказать обо всем невозможно. Ясно, что истоки - из академии, академических исследований. Национальные лаборатории – и есть академические исследования, одно другому не противоречит. Я, наверное, неправ, что не указал конкретно астрономию, но…

Александр Московский: Тот же вопрос с адронным коллайдером…

Игорь Рубенович Агамирзян: Я прошу прощения, но вопрос с адронным коллайдером – очень близко связан, но не совсем то же самое. Здесь не прозвучала одна очень принципиальная вещь. Big data становится ценной не тогда, когда ее просто много, а когда возникает возможность сравнения ранее несравнимых данных. Сейчас стало возможным сопоставить то, что раньше было несопоставимым. И это дает некоторую новую ценность для всех участников рынка - и, кстати говоря, государства. Государству в каком-то смысле это даже более важно, чем рыночным компаниям, потому что у вторых, как правило, есть четкие фокусы, а среди задач госуправления - задача сопоставления данных из разных, несвязанных источников является чрезвычайно актуальной при принятии многих принципиально важных решений. Я на этом прервусь, хочу еще раз поблагодарить выступавшего. Следующим хочу предложить выступить Вячеславу Нестерову, руководителю центра разработок корпорации EMC в Санкт-Петербурге.

Вячеслав Нестеров: Здравствуйте! Я надеюсь, что мне удастся быстро добавить несколько штрихов к очень интересному докладу, который мы только что прослушали. Эти штрихи будут с позиции индустрии, потому что я представляю компанию EMC, она неоднократно упоминалась здесь. Компания, которая позиционирует себя как сильный игрок на этой арене.

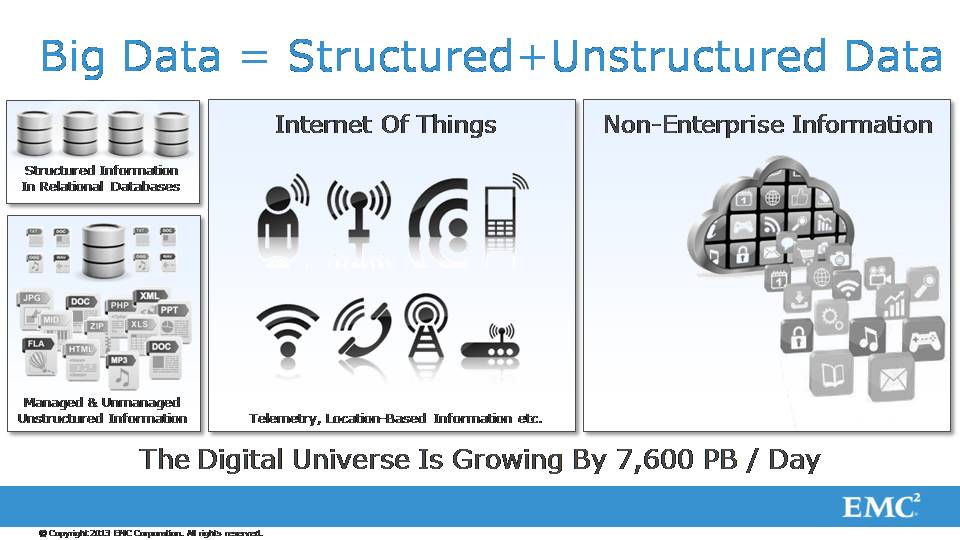

Сейчас буквально в двух словах о том, где мы находимся. Понятно, что касается big data, ландшафт этот можно представить как место, где производят большие данные, где они генерируются, на другом конце находятся компании и люди, которые потребляют эти данные и то, что из них удается получить. Посередине находится некая структура, которая, собственно, и осуществляет этот самый анализ. Внизу находится железная платформа - те хранилища данных, которые способны справиться с хранением данных, те вычислительные мощности, которые способны обработать эти данные. Дальше - платформа поверх железа, которая позволяет обрабатывать данные. Этот стек состоит из большого количества слоев. Наверху map reduce, Hadoop и другие системы, о которых мы говорили, а на самом верху applications, которые позволяют аналитикам больших данных работать с ними. Компания EMC – это компания, которая позиционирует себя как несколько нижних слоев этого стека, начиная с устройств хранения информации, плюс нижние слои средств ее обработки, и до определенного места. Applications – то, что создается на базе наших продуктов.

Я все-таки еще раз скажу несколько вещей, часть из них неслучайна. Понятно, что данные сейчас генерятся в очень большом количестве мест. Здесь даже написано, что данных каждый день появляется около 7000 петабайт. Надо что-то делать, это можно как-то использовать. Уже было сказано, не буду повторяться, данные есть структурированные и нет. Вроде бы как есть оценки, что на сегодняшний день не больше 10% данных структурированы, и эта пропорция продолжает увеличиваться в пользу неструктурированных данных. Очень большой объем данных генерится интернет-приложениями - как телефонами, так и девайсами, обрабатывающими огромные объемы данных. Часть данных в общем объеме, которая генерится интернет-вещами, - это 15%. К 2020 году предполагается, что интернет-продукты будут генерить около 40% всех данных. Собственно, эти данные являются одним из важнейших источников информации.

И еще одна тенденция, которая хорошо известна, - это то, что личная информация хранится не в личных хранилищах, а в облачных или физических местах, которые относятся к enterprise. Люди хранят свои фотографии не в своем компьютере, а в облаках.

Здесь несколько картинок, я не буду, конечно, обо всем этом рассказывать. Откуда берутся большие данные? - тенденция очень интересная. Я буквально о нескольких вещах скажу. Очень много данных в общей пропорции генерятся всякого рода сетями, промышленными сетями, в частности - сетями передачи радиоэнергии. И оттуда поступает очень много данных, из которых тоже можно извлекать очень полезную информацию. Еще один пример, кстати, было сказано в докладе о health care, но там прозвучала немного другая мысль о том, что можно извлечь полезную информацию, обрабатывая медицинские записи большого количества людей.

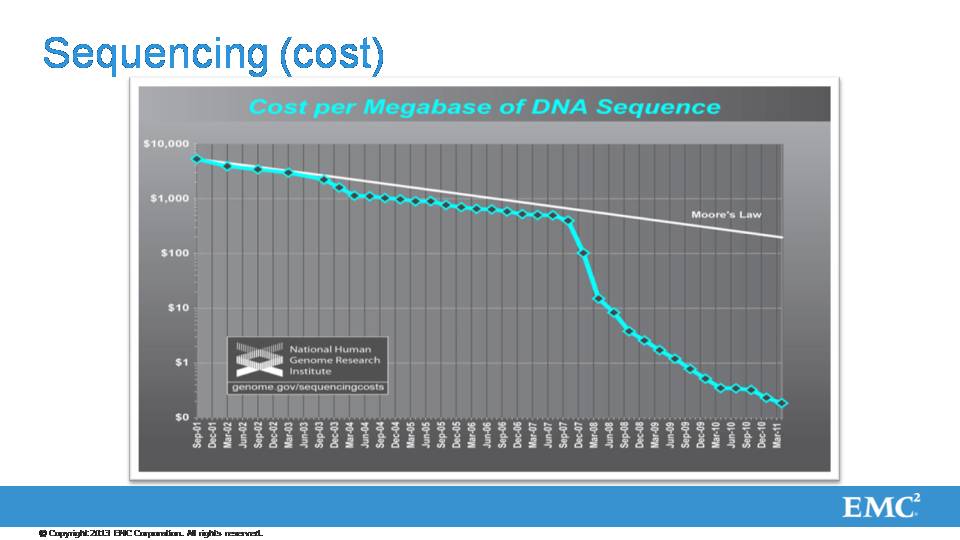

Есть еще один аспект, связанный со здравоохранением, а именно - геномная информация. И эта вещь развивается сейчас очень быстро, и это связано с одним очень простым фактом, что стоимость получения генома одного человека падает быстрее, чем экспонента. Соответственно, количество информации, которое в ближайшее время будет получаться путем исследования генома конкретного человека, будет расти тоже быстрее, чем экспонента.

Геном человека – это три миллиарда пар нуклеотидов. Казалось бы, не так много информации. Но суть в том, что помимо той информации, которая уже собрана, там хранится много сырой информации, на тех аппаратах, которые этим делом занимаются. Информацию сырую тоже полезно хранить из разных соображений.

Интересная, кстати, зависимость, с которой мы столкнулись, - это как падает стоимость получения геномной информации. Это, заметьте, логарифмическая шкала. Это сентябрь 2001 года, это март 2011 года. Первый геном вообще был синтезирован за 6 миллиардов долларов, это был международный проект. На сегодняшний день стоимость получения одного генома в районе 1000 долларов. Я такой закономерности вообще нигде не видел. Это даже не экспонента, потому что экспонента на логарифмической шкале выглядит как прямая. Отсюда будет появляться гигантский объем информации - будет, потому что сейчас это все только начинается.

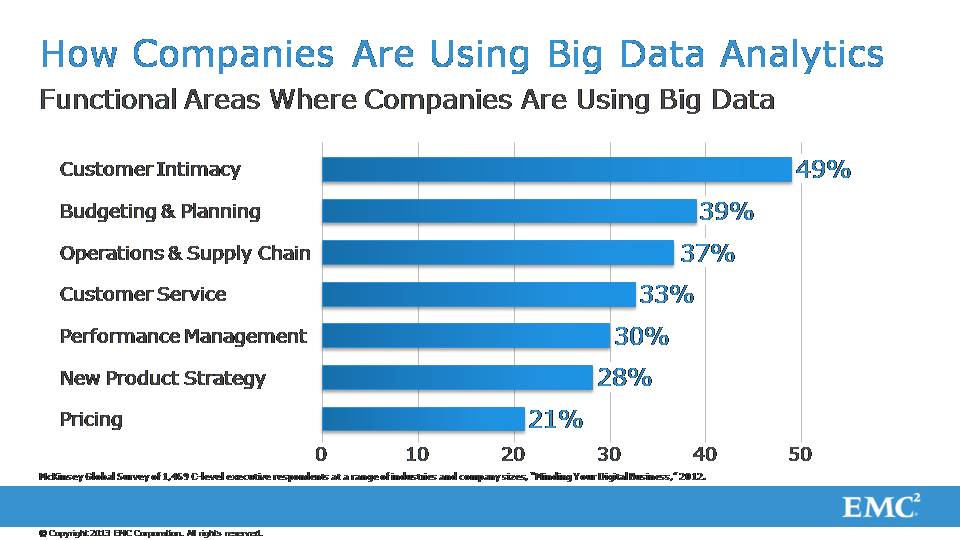

Для чего компании собираются использовать данные, полученные путем применения технологии больших данных? Вы видите. Был проведен опрос около 1500 менеджеров больших компаний. Их спросили, для чего им нужны большие данные. 49% сказали, что им эти большие данные нужны, чтобы лучше понимать своих заказчиков, чувствовать, что им нужно, анализировать потребности рынка. 39% - для того, чтобы более эффективно заниматься планированием и бюджетированием. И так далее.

Не буду на этом останавливаться, это те же самые 3 V. Это характеристики больших данных. Объем, разнообразие и скорость, с которой их нужно обрабатывать.

Здесь мы уже переходим к следующему. Почему компания EMC всего 1% бизнеса использует на большие данные? Почему, несмотря на то, что так немного это все приносит, мы беремся за это дело? Это некая иллюстрация к причинам того, что большие компании из других областей двигаются в эту область. Выясняется, что существующая инфраструктура, те слои стека, о которых я говорил, совершенно не удовлетворяют потребностям анализа больших данных по самым разным причинам. По причине низкой производительности, объемов, если говорить о хранении данных, по причине тех примитивов, которые они предоставляют для доступа к данным, по тем параметрам, которые связаны с возможностью масштабирования систем, которые сейчас существуют. Короче говоря, более или менее очевидно, что для того, чтобы успешно заниматься анализом данных, необходимо строить новую инфраструктуру, которая через некоторое время вызовет новый сектор IT-бизнеса. Компания EMC – классический бизнес, основная часть которого – хранение информации. Это высоконадежные, большого объема системы для хранения информации, которые последние 30 лет используются достаточно активно всевозможными компаниями, банками и т.д. Поэтому естественно, раз текущая инфраструктура для растущего сектора не годится, пойти в соседний сектор бизнеса и сделать продукцию, удовлетворяющую новым потребностям.

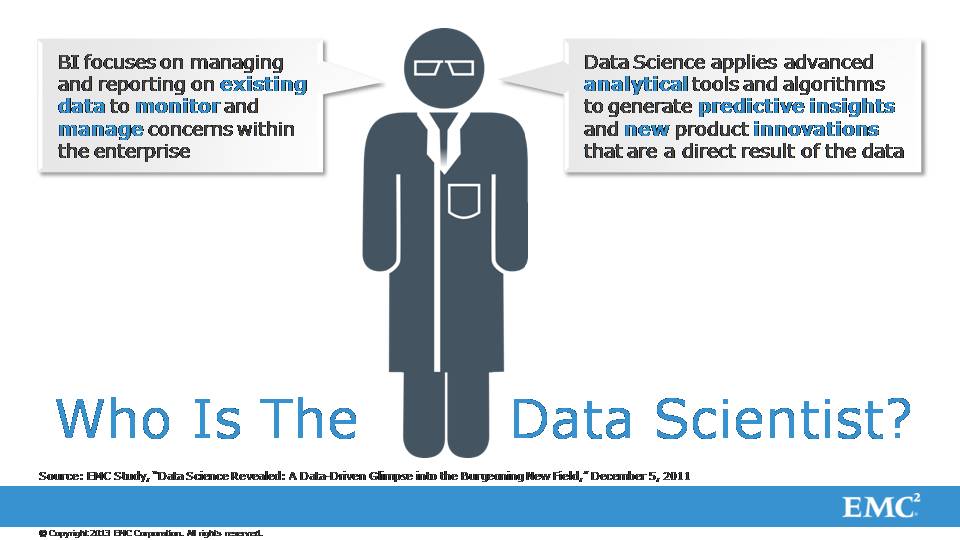

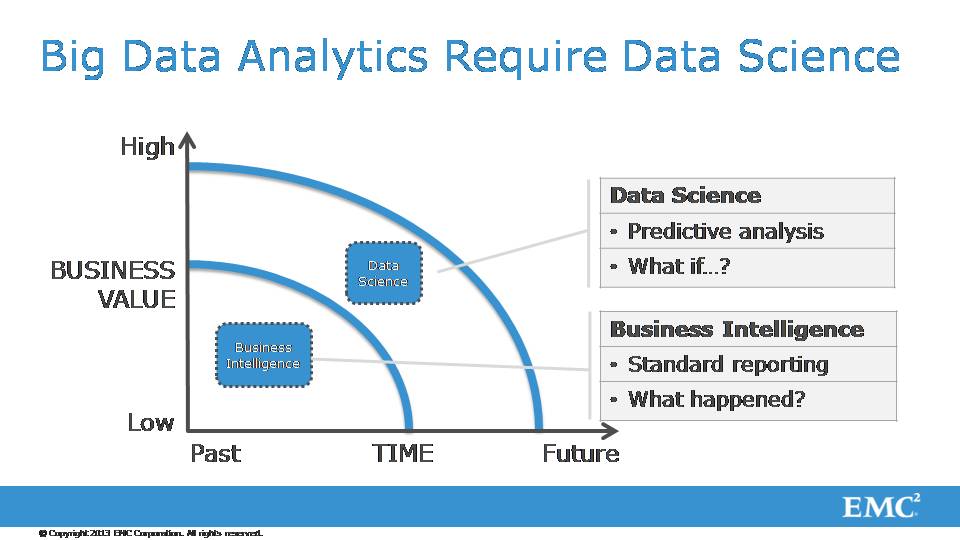

Эта мысль тоже уже была, я с ней полностью согласен. Для того чтобы все это развивалось, необходим принципиально новый человек - специалист для работы с большими данными. Можно сделать такое соотношение того, что было, и того, что стало. Раньше были бизнес-аналитики, теперь есть data scientists. Согласно данным нашей компании, бизнес-аналитики – это те люди, которые исследовали данные и делали из них какие-то выводы из прошлого, а анализируя набор какой-то информации за какой-то промежуток времени, могли сделать выводы о том же самом промежутке времени, какую-то визуализацию этой информации, дать суммарные результаты. А аналитики больших данных – это люди, которые, скорее, могут отвечать на вопросы «а что если?». Они смотрят вперед, анализируют те данные, которые обращены в будущее. Совершенно согласен с тем моментом, что таких людей, которые владеют всеми необходимыми знаниями, имеют представления о той предметной области, о которой идет речь, таких людей не хватает. Это еще одна составляющая той инфраструктуры, про которую я говорил в самом начале.

Я слышал такое мнение, что настолько дефицитна эта специальность в мире, я не говорю уже о России, что в Калифорнии это единственная специальность, по которой человек, сразу закончив университет и не имея опыта работы, может зарабатывать 100 тысяч долларов в год, а это считается недостижимым для других IT-специальностей без опыта работы.

Это иллюстрация к тому, чем data-аналитик отличается от того, что называется бизнес-аналитикой. У нас есть система координат, по одной оси - польза от специалиста, по другой координате просто отложено время. С течением времени нужно смещаться в область аналитики больших данных, чтобы приносить максимальную пользу.

Из чего же складывается этот ландшафт, с которого я начал, инфраструктура? В самом низу - устройство для хранения больших данных, которое может активно расти и масштабироваться. Такие устройства могут быть физическими, на классическом принципе построены, просто стоимость инфраструктуры заставляет это все делать виртуализованным и достигать масштабированности. Во-вторых, чтобы все это было достаточно эффективно и было на высоте.

Следующий этап – это платформа, которая является параллельной. Тут один из продуктов, который принадлежит нашей компании, изображен. Это некоторая аналитическая платформа, без которой анализ больших данных невозможен.

Дальше присутствуют люди, без которых тоже ничего не бывает, с инструментами, которыми они умеют пользоваться. Ну и, наконец, на самом верху находятся гибкие аналитические приложения, которые реализуют ту бизнес-логику, которая требуется. Вот, собственно, все, что я хотел сегодня сказать. Вывод такой. Думаю, что после первого доклада не осталось никаких сомнений в том, что большие данные трансформируют большие области бизнеса и понимание, как значительные сектора бизнеса могут жить и развиваться. Подход к обработке больших данных отличается от того подхода, который был классическим, который был раньше. Наконец, необходимо для успехов бизнеса уметь успешно работать с этими самыми большими данными.

Игорь Рубенович Агамирзян: Коллеги, если есть вопросы, давайте еще один-два вопроса зададим и перейдем к следующему участнику.

Сергей Абрамов: Не знаю, насколько он будет кратким, произошла расфокусировка. В первом докладе говорилось, что идея была использовать очень простое ненадежное железо для хранения, а вы сказали, что EMC предлагает высоконадежное, качественное железо.

Вячеслав Нестеров: Ну да, EMC считает именно так. Специально для этого мы купили компанию, которая предлагает именно такое высоконадежное, хорошо масштабируемое файловое хранилище.

Игорь Рубенович Агамирзян: Это, на самом деле, тема для дискуссии, потому что подходы, явно видно, здесь разные. Давайте, мы тогда сейчас послушаем последнее выступление Сергея Лихарева из IBM и потом уже перейдем к этой дискуссии. Хорошо, что такие моменты обозначаются.

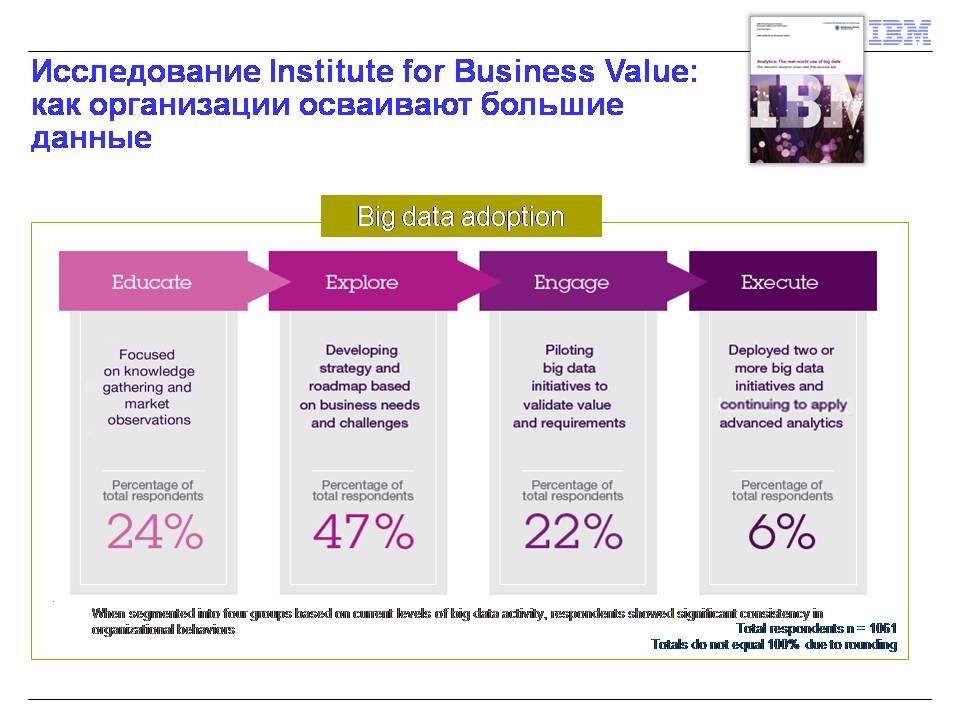

Сергей Лихарев: Я теорию, наверное, не буду рассказывать. На самом деле, чем хорошо работать в большой компании - это слайд 34 в первой презентации. Институт бизнес-ценностей – это организация, которую IBM финансирует, и мы проводим много исследований, разговариваем с руководителями организаций, что они делают с большими данными сейчас.

Вот картинка, которая была последней получена нами. 6% делают что-то – 1-2 инициативы в области больших данных, которые работают. 22% пилотируют, то есть пытаются понять, что из этого может быть. 47% строят бизнес-кейс. Они еще считают, что большие данные могут им принести. 24% самообразовываются. С точки зрения тендеров, почему все туда побежали? Здесь мало что уже можно продать, именно это есть рынок. Рынок компаний, которые еще не приняли решение, которые думают, как из этого можно извлечь бизнес-ценность.

С точки зрения платформы. Какие требования можно предъявить, когда компания говорит, что хочет работать с большими данными? В первую очередь, понимание навигации. Когда у нас много этого хозяйства есть, нужно понять, как это и где находится. Во-вторых, Hadoop, многие говорят, что он – это большие данные. Это одна из частей. Место, куда я сложу информацию в огромных объемах, но это еще не все. Потому что традиционные хранилища никто не отменял. Те самые 100-200-терабайтные хранилища, которые есть и требуют очень быстрого ответа. На Hadoop этот ответ получить сейчас невозможно. Традиционные хранилища не умирают, им предъявляются немного другие требования. Люди хотят, чтобы сотни терабайт быстро обрабатывались, чтобы они были легкие, по возможности более дешевые. Огромный пласт задач вот здесь, потоковых данных. Почему? Потому что мы начали работать с видеоинформацией. Идет поток, постоянная телевизионная картинка, из этого можно что-то выхватывать. Один из примеров проекта, который я видел в Штатах, - это ураган. Идет ураган, а они на ходу обсчитывают траекторию движения урагана, что происходит в этот момент. Они пытаются понять риск поражения территории, они обсчитывают потенциальный ущерб, оптимизируют цепочки поставок, чтобы если ураган будет продолжать двигаться по этой территории, максимально быстро насытить этот район товарами, которые потребуются в результате этого катаклизма. Очень много вещей. Statoil, нефтяная компания, они фотографируют со спутника льдины, как они тают, у них стоят датчики везде, и за счет того, что они немного продлевают период добычи нефти, они экономят 200 миллионов долларов. Чем ближе к реальному времени, тем круче. Неструктурированные данные. Опять же, мы о себе очень много говорим, из этого надо извлекать пользу. Если платформа не позволяет этого делать, значит, с большими данными будут проблемы. В силу того, что мы их накапливаем, политики удаления, сохранения, обеспечения больших данных должны существовать в платформе.

IBM пытается коммерциализировать эти вещи, поэтому я приведу, может быть, пару примеров из медицины, но тем не менее. Области, в которых, мы видим, большие данные принесут огромную пользу. В данном случае, мы взяли четыре. Новый взгляд на клиента - это то, что мы видели на слайде. Компании пытаются лучше понять своего клиента, безопасность, анализ операций и расширение традиционных хранилищ данных. Теперь по каждому из них немного более подробно.

Глубже понимать настроение клиента из внешних и внутренних источников. Я позвонил, мой голос записался, я могу распознать, о чем говорю, сейчас это достаточно легко, сохранили текст моего сообщения, потом его анализируем. Всю информацию везде я добровольно о себе сообщаю. Если я умею что-то извлекать из этой информации, это здорово, потому что я могу выявить тенденции, что заставляет моих клиентов принимать эти решения, рекомендовать или нет мою компанию, у них есть общие черты, либо нет. Мало того, я хочу это сделать не постфактум, я хочу приблизить это к моменту, когда я непосредственно звоню. Когда я положил трубку, возможность закончилась. Поэтому если я могу выяснить потребность в момент, когда человек со мной разговаривает, это еще более интересный вариант. Компании пытаются с помощью больших данных понять, как лучше взаимодействовать с клиентом, что ему в этот момент предложить, как потом выяснить его реакцию. В мдм (менеджменте) содержится вся базовая информация обо мне. У нас в России компании могут себе позволить создавать с нуля систему. Если это западная компания, 20 лет разработок, 15 хранилищ информации о клиенте, они как-то все-таки к этому приходят.

Давайте подумаем вот о чем. В Киев многие летали? Приезжаем в аэропорт, вставляем карточку в банкомат, через 5 минут нам звонок о том, что мы попали в страну, где есть повышенные риски. Классически сработала система безопасности. С другой стороны, я в Москве, проходит транзакция по моей карточке, для банка это вроде бы не рисковая страна. При этом я о себе в твиттере в этот момент пишу «как здорово находиться на Мальдивских островах, вот фотография». Если я эту информацию сопоставлю, моя транзакция моментально станет более рисковой. Мы это просто иногда отбрасываем, потому что раньше не думали, что это возможно обрабатывать, или не хотели. То есть здесь можно думать за рамками того, что сейчас происходит. Можно ли принимать новые решения на основании того, что стал доступен новый источник информации? Если да, то, возможно, большие данные нам помогут эту задачу решать.

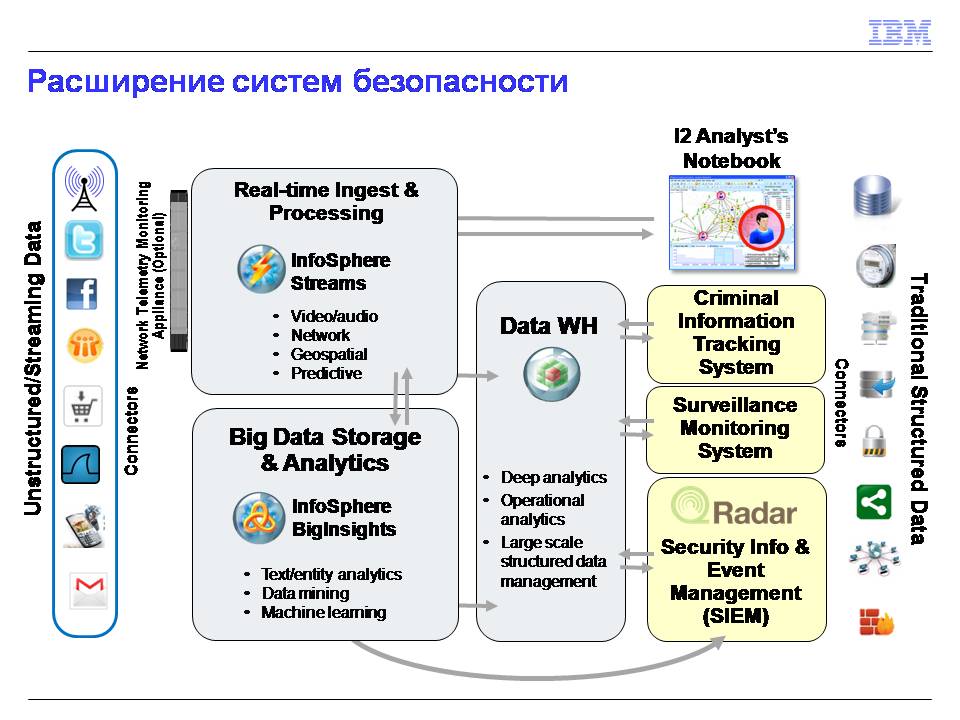

Безопасность. Здесь очень много интересных моментов. Компании типа Splunk. Логи – огромное количество информации, которая поступила, а дальше что? Дальше нужно проанализировать, были ли угрозы безопасности. Я с одним администратором разговаривал, он сказал, что идут логи, я их вижу, при этом у меня все равно стоит камера, которая снимает серверную комнату. Туда зашел человек, что-то поделал, я увидел, что по логам что-то прошло, а с другой стороны, он не выполнил то, что должен был по должностным инструкциям. Сопоставив информацию, он мог сказать, что было сделано что-то, что было, возможно, потенциально плохо для безопасности этого банка.

Предсказание и предотвращение атак. Опять же, постфактум понять, что что-то было плохое, не здорово, хочется в реальном времени. Когда пошло событие, которое потенциально может связаться с неблагоприятными вещами, лучше сразу это выяснить.

Социальные данные и коммуникации. Опять же, все провайдеры нашей и других стран имеют регулярные запросы от наших ведомств о предоставлении информации и CDR. Это все из области больших данных, их нужно сопоставить, принять решение, выявить какие-то сложные вещи, это большой рынок для подобных решений и компаний.

Традиционные системы, департамент полиции Нью-Йорка. Ребята говорят, что если в течение 30 минут они не поймали преступника, шанс поймать его резко падает, это нужно сделать моментально. У них сценарий работы такой: когда происходит преступление, в момент, когда полицейский приезжает на место, система ему уже выдает список потенциальных подозреваемых. Как могут быть расширены традиционные системы? Все фотографии, свидетельства очевидцев, прошлые преступления – это доступно. Идет информация преступления с видео, мы можем сопоставить лицо преступника, это дополнительные моменты, которые позволяют нам быстрее раскрывать преступления.

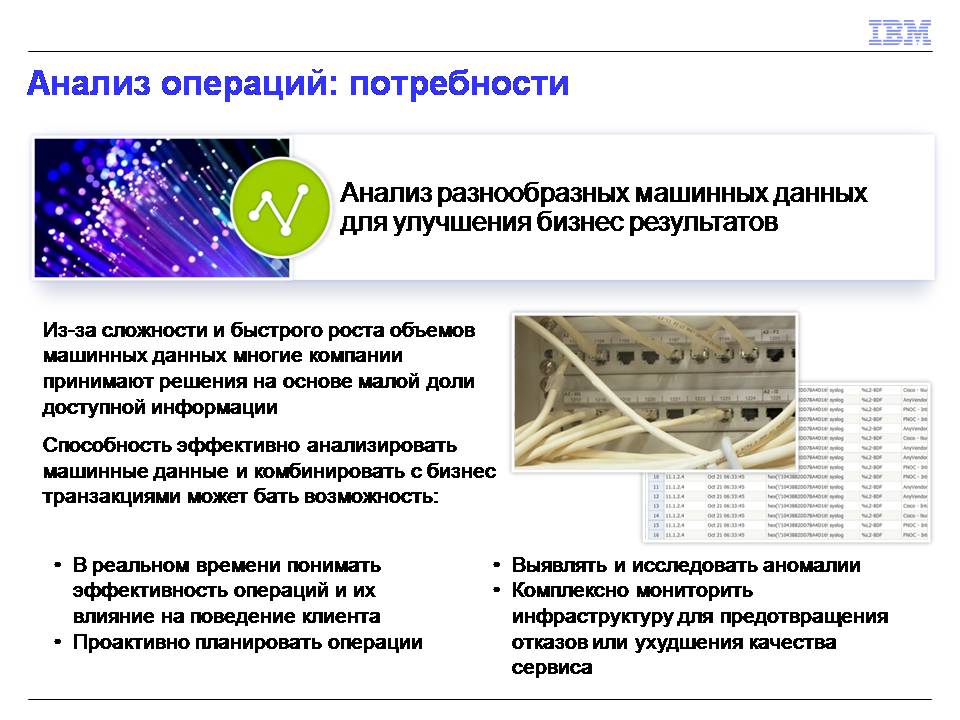

Анализ операций. Машинных данных много, наша задача – сопоставить это с бизнес-операциями. Не просто сказать, что у нас упала сетка, а сказать, что падение сетки в этот момент повлияет на 20% наших самых ценных абонентов, поэтому это допустить нельзя. Вещи, которые позволяют бизнесу лучше обслуживать своих клиентов. Что нам нужно для этого? Проанализировать инфраструктуру, сопоставить это с бизнес-транзакциями. Опять же, огромный объем, и желательно побыстрее.

Еще один момент здесь. На Западе очень актуально, у нас постепенно актуальность нарастает. Регуляторы заставляют нас хранить данные как можно дольше, поэтому встает вопрос: а все ли данные нужно сохранять? Или я могу положить в хранилище только ту информацию, которая мне действительно понадобится? То есть снизить стоимость хранения за счет предобработки, желательно - в реальном времени. Задача, с первого взгляда, неочевидная, но, тем не менее, очень полезная.

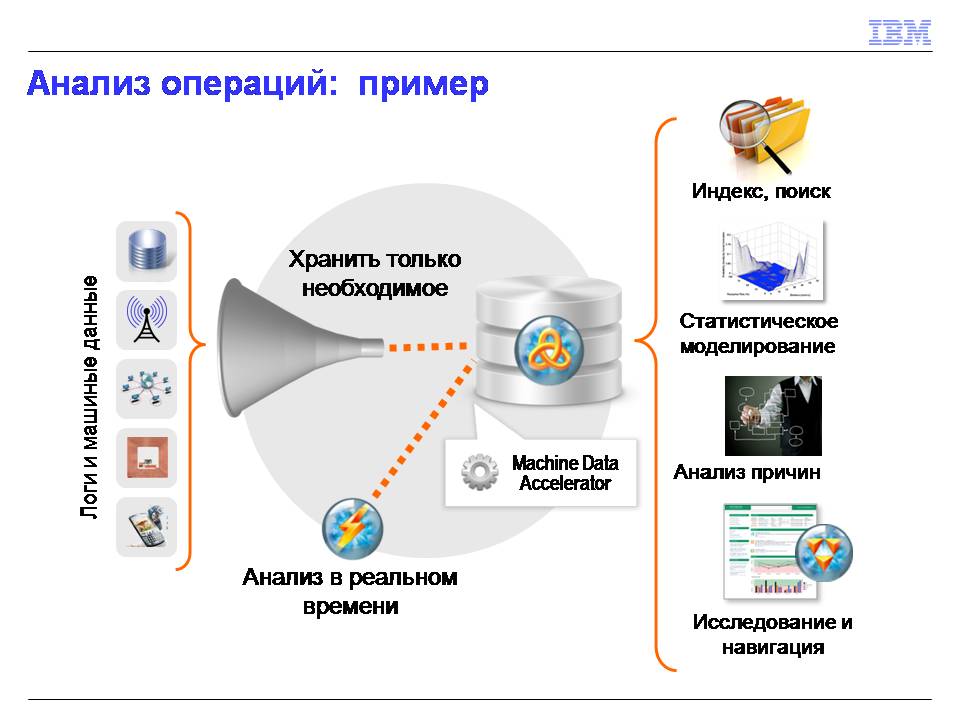

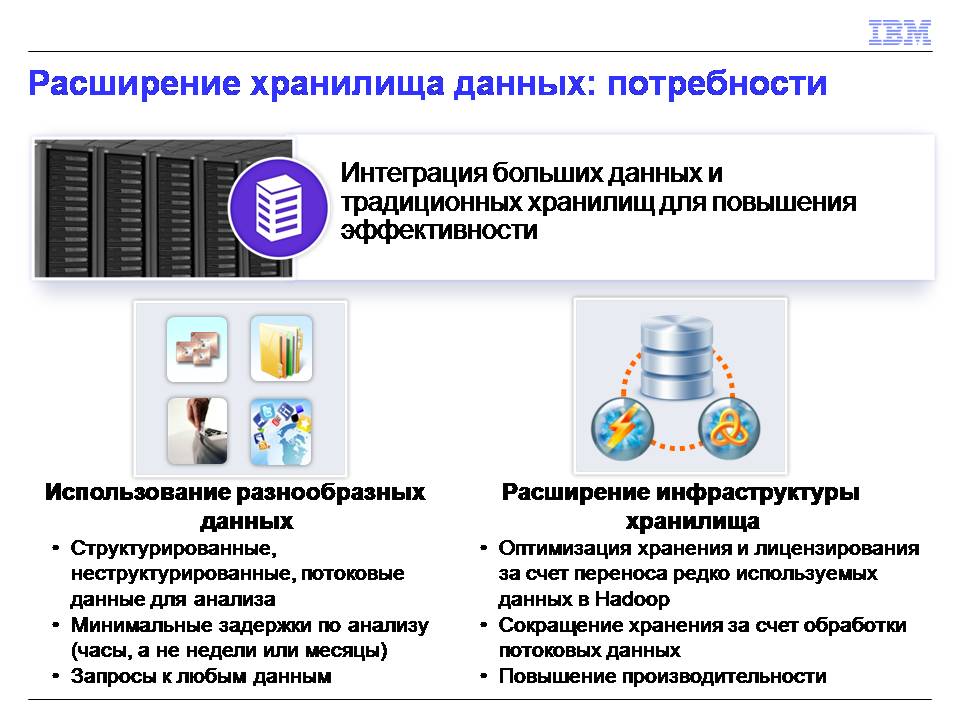

Традиционное хранилище данных когда становится большим и дорогим, встает вопрос, что делать. Вроде как, данные хочется проанализировать, но следующий счет на развитие инфраструктуры становится таким большим, что мы начинаем сомневаться. Из-за этого мы видим ситуации, когда очередь из проектов на бизнес-аналитику на ближайшие два года расписана, и IT говорит, что мы не можем так быстро расти. Данные переполняют инфраструктуру, а на IT не дают денег. Что можно в этом случае делать? Hadoop может очень здорово разгрузить, есть технологии, которые сейчас позволяют делать запросы по этим данным.

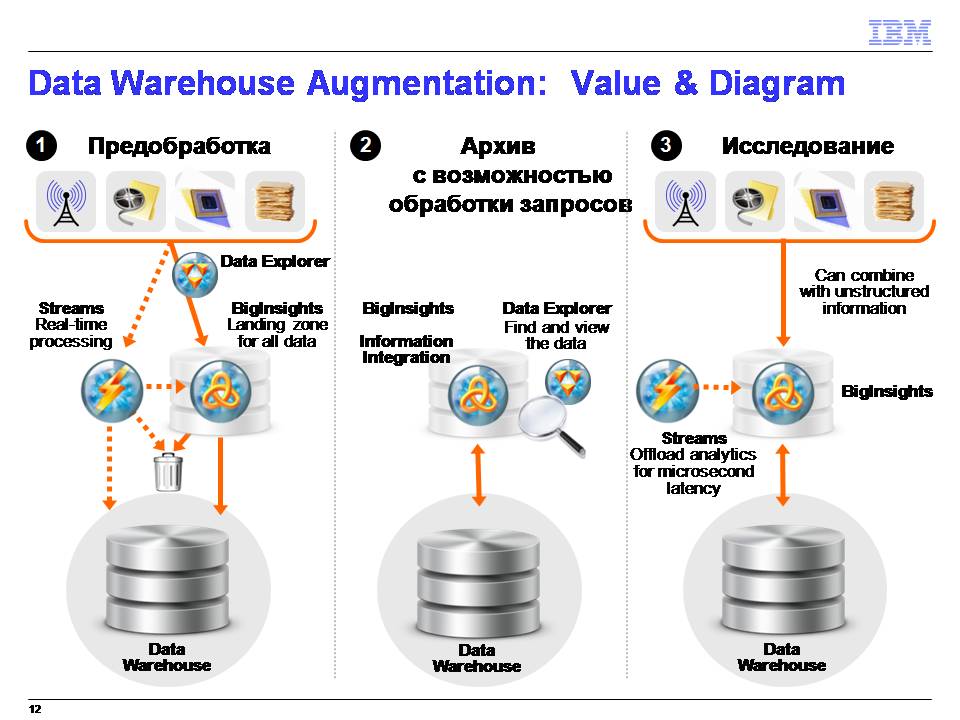

Здесь несколько сценариев, я просто привел пример. Можно делать предобработку, архивы с возможностью запросов по ним. Или можно делать исследования. У меня появился новый источник данных, я научился его сохранять. Вопрос, мусор там или не мусор, что с этим делать? Сейчас я могу это сбрасывать в Hadoop, относительно дешевый способ хранения, а потом решать, что делать с данными. Вещи, которые позволяют управлять ростом традиционного хранилища, но при этом сохранять бизнес-ценность от новых источников данных.

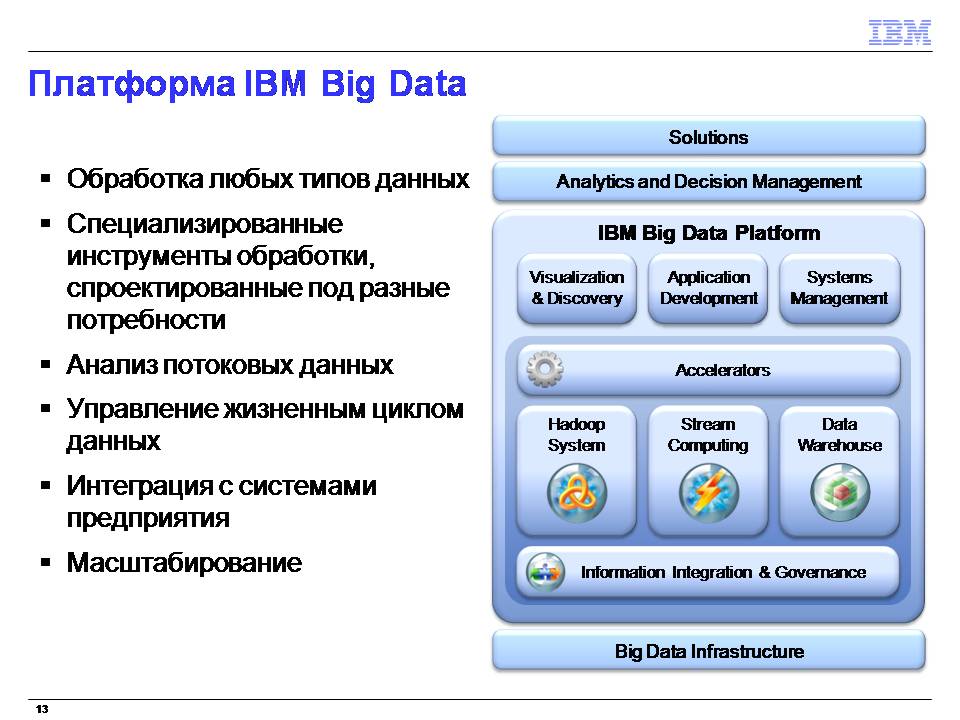

IBM. Он, конечно, покрыл всю платформу от и до. Что хорошего, мы считаем, мы делаем для проектов? С точки зрения Hadoop, мы ориентируемся полностью на open source. Удобная установка в масштабах предприятия, администрирование, средства разработки, визуализации. Для понимания, что такое средства разработки. Много лет назад мы изобрели SQL, язык традиционных запросов к базам данных. Сейчас для всех этих продуктов мы сделали декларативные языки, то есть языки высокого уровня для обработки текстов и потоковых данных.

Акселераторы – это шаблоны приложений, решений, которые позволяют быстрее реализовывать определенные проекты. Например, акселератор для работы с машинными данными. Или шаблоны для работы с акустическими данными.

То, что мы видим у заказчиков, когда они начинают говорить про платформы. То, откуда многие пришли, здесь получается Hadoop. Потоковые данные, немногие сейчас об этом говорят. Мне понравился пример - я разговаривал с ритейлером. Я ему сказал: «Хорошо, Hadoop – здорово, хранилища – понимаю. Но я не вижу для вас бизнеса в ритейле». Он говорит: «Подожди. В любом магазине стоит камера, она фиксирует вход людей в магазин. Если ты видишь очередь людей на кассе, ты разворачиваешься и уходишь. Я вижу, что вошло 20 человек, и я знаю, что мне понадобится еще 1 человек в торговом зале, чтобы с ними работать. Через 10 минут мне потребуется дополнительный человек на кассе, чтобы не создавать очередь и ушедших клиентов». По сути дела, в рамках больших магазинов вся эта инфраструктура уже есть, просто надо научиться анализировать на ходу и подстраивать свои операции, не просто сохранять поток информации. Для меня это было откровением. Моя посылка здесь – сейчас мы пришли в состояние, когда стало технологически возможно обрабатывать любые объемы разнородных данных, поступающих с разной скоростью. Надо теперь придумать, как это применить к бизнесу, чтобы он рос. На самом деле, решений очень много.

Пример из медицины, достаточно известный. Канадский неонатальный институт. Идея такая. Организм человека, когда ребенок рождается, у него очень сильно скачут показатели. Как только возникает угроза жизни человека, организм резко выравнивает все показатели, он резко бросает все силы на выздоравливание. Прибор способен за 24 часа до наступления события сказать, что именно с этим ребенком будет, возможно, что-то не так. Смертность в контрольной группе упала на 20% только из-за того, что они научились использовать и внедрять такие технологии.

Из азиатских проектов. Снимки, идет флюорография. Человек, просматривая снимки день за днем, начинает ошибаться. Они научились прогонять эти снимки через алгоритмы и выявлять случаи, типично попадающие под определенный сценарий. Человек принимает участие в меньшем количестве операций. Сценариев не только для бизнеса, но и для здравоохранения достаточно много. В этом случае снимки лежат в Hadoop. Все. Спасибо большое за внимание.

Игорь Рубенович Агамирзян: Спасибо большое, коллеги. Предлагаю один-два вопроса конкретно по этой реплике, потом переходим к обсуждению. Да, пожалуйста.

Вадим Сухомлинов: У меня такой вопрос. Какие вы предложите технологии по работе с неструктурированными данными? Видео, аудио, смысловая текстовая информация. Есть вообще какие-то серьезные прорывы в этой области?

Сергей Лихарев: Текст. Язык мы разработали, который позволяет выделять объекты, шаблоны, оценивать оттенки текста. С точки зрения видео-аудио. Сейчас в платформе используются open source библиотеки, в которых можно дорабатывать. В лабораториях IBM есть проекты, когда эти библиотеки дотачиваются под нужды конкретных заказчиков.

Александр Брызгалов: Когда IBM Research поможет решению московских пробок?

Сергей Лихарев: Мы выходили с этим делом. Просто до правительства не донесли. Мы готовы к диалогу, на самом деле, потому что в Осло проект реализован, там общественный транспорт обвешен этими датчиками, мы собираем информацию, кто куда поехал. За счет этого, исходя из ситуации на дорогах, мы можем сказать, что во вторник автобус от такой до такой точки будет идти чуть дольше, а вообще это приведет к 10-тибалльным пробкам.

Игорь Рубенович Агамирзян: На самом деле, IBM занимается темой Smart city очень активно. Вопросов больше нет. Переходим к дискуссии. Я не знаю, может, предложить выступавшим выйти сюда, чтобы быть в процессе дискуссии лицом к лицу с публикой. Кстати говоря, к вопросу big data могу сказать, что, судя по всему, у нас налажен стриминг в интернет. Потому что я в Facebook уже увидел публикацию с фотографией из этой комнаты, а автора здесь, в этой аудитории не вижу. Кто хочет выступить?

Эдуард Пройдаков: У меня просто общий вопрос к каждому из выступающих. Вы все рассказывали о том, что сделано в больших данных. Вопрос мой в том, что не сделано, и в чем проблема? В чем состоит проблема применения?

Леонид Жуков: В области больших данных? Во-первых, вы абсолютно правы, практическое применение. Сами по себе большие данные, если хранятся, тут вопрос цены. Вопрос в извлечении смысла, информации и знаний. Если вы говорите, что вы можете извлечь информацию из потока видео, увидеть лица, - как понять, мужское или женское это лицо? Как понять, кто это? Технологии разрабатываются, это та грань науки, над которой все сейчас работают.

Вячеслав Нестеров: Я думаю, серьезная задача еще связана с тем, что нужно сопоставлять эту самую аналитику, взятую из совершенно разных мест. Совместить информацию с камеры и с кассового аппарата, плюс посмотреть еще на что-нибудь, что вообще находится вне магазина, сложнее, потому что это большая аналитика.

Комментарий из зала: Это вопрос кастомизации.

Сергей Лихарев: Еще это вопрос инвестиций. Почему сейчас многие строят бизнес-кейсы? Они действительно пытаются понять: если сейчас вложат определенную сумму денег, получат ли они отдачу.

Марк Шмулевич: Мне кажется, что важно сейчас, новая идеология открытых данных, еще то время, когда стоит вопрос, какие именно данные будут открытыми. Это вопрос дискуссионный. Здесь важно, с чего начинать, потому что пройдет много времени, прежде чем все государственные данные станут открытыми. Но если хорошо понимать, что более эффективно для экономики, какие наборы данных должны быть открыты в первую очередь, будет хорошо.

Вячеслав Нестеров: Еще есть, конечно, проблема, связанная с теми данными, которые хранятся. Приведу один пример из области биоинформатики. На данный момент генетическая информация хранится в разных исследовательских базах данных в разном формате. А что такое данные в этой области? Это информация о геноме и фенотипе, о том, как особенности генома проявляются на человеке – какие у него заболевания, особенности, предрасположенности и т.д. Чтобы это объединить и получить действительно большие данные, нужно все это вместе слепить, а это очень сложно.

Константин Скрябин: Не могу удержаться после этой фразы. Я хотел просто сказать о том, что если вы возьмете венчурное финансирование, которое было в 2012 году на производство лекарств, оно в 2 раза упало. А венчурное финансирование на digital, половину которого занимает big data, увеличилось в 4 раза.

Игорь Рубенович Агамирзян: Коллеги, я хотел бы тоже здесь прокомментировать. Я еще раз хочу подчеркнуть то, что уже прозвучало несколько раз из разных источников. Реально большие данные становятся полезными и интересными тогда, когда возникает возможность сравнивать исходно несравнимые вещи. Причем это не только в области больших данных. Во многих технологиях возникает новое качество при добавлении дополнительных источников. Microsoft показывал компанию, которая занимается распознаванием речи. Вроде бы как в алгоритмах распознавания речи ничего особенного нет, но они к этому добавили обработку видеопотока, которая следит за губами, - и качество повышается от традиционных 92-94% до 98-99%, где уже можно реально работать. Но это просто пример того, что сопоставление оригинально несопоставимых вещей дает новые возможности. Второе. Есть одна область, которая тоже уже упоминалась, но, на мой взгляд, незаслуженно обходилась вниманием. Это все, что связано со всякими гридами - и не только в энергетике. Насколько я знаю, по Евросоюзу есть директива, по которой к 2020 году 80% домохозяйств должны быть оборудованы smart meters. Огромный поток данных, собираемый со всего континента, по энергопотреблению в каждой конкретной точке с точностью до домовладения. Имея эту информацию, возможность ее аналитически обрабатывать и на ее основе принимать решения в реальном времени, можно повысить энергоэффективность на 15-20%. Это то, ради чего делается смарт грид. Он становится реально влияющим на всю систему, когда он доходит до конечного потребителя, до самого низа. Скорее всего, то же самое будет во всех процессах, связанных с применением цифровой обработки информационных технологий в реальном секторе экономики, в производстве. Потому что управление большим сложным производственным комплексом генерит огромное количество данных со всех датчиков.

Вячеслав Нестеров: Есть одно замечательное приложение у смарт гридов в нашей стране, оно обсуждалось недавно. Это предотвращение воровства электроэнергии. Если есть хорошая сеть трансмиттеров, то выявить точку, из которой вытекает электроэнергия, не представляет абсолютно никакого труда.

Вадим Сухомлинов: А безопасность данных? Если я в реальном времени могу анализировать их показатели, я могу тогда сказать, кто пришел домой, кто ушел из дома.

Анджей Аршавский: Вы, когда рассказывали историю, говорили о том, что компьютинг, связанный с большими данными, пришел на смену коммодити компьютинг. Но на самом деле, они живут в параллели. Один занимается моделированием, второй, big data, занимается обработкой больших данных. Не могли бы коллеги привести примеры, где эти две области сейчас встречались бы? Где можно было бы обрабатывать большие данные и одновременно заниматься моделированием.

Игорь Рубенович Агамирзян: Одно из известных приложений high performance computing’а - это системы краш-тестинга. Их моделируют в автомобильной промышленности, во всем машиностроении. Я не специалист в этом, но знаю, что всегда ведутся и натурные эксперименты, потоки данных собираются уже с конкретного физического объекта. Могу предположить, что, скорее всего, в какой-то точке это должно сходиться.

Леонид Жуков: Например, финансовые рынки. С одной стороны, обсчет формы Блэк-Шульца, вычисление ожидаемых стоимостей, с другой стороны, мы накапливаем огромные объемы данных. Геология - когда идет расчет дифференциальных уравнений, расчет породы, структуры, с другой стороны, получены сейсмические данные. Метеорология. На самом деле, довольно много пересечений. Я пытался сравнить тему суперкомпьютинга, потому что она известна, и те алгоритмы оказались неприменимыми, есть большая вероятность того, что компьютеры ломаются.

Анджей Аршавский: Вы говорили о задачах, где нужно в реальном времени принимать какие-то решения. В то время как big data – это не задача реального времени.

Леонид Жуков: Не совсем так. Hadoop, его нынешняя технология – это бэтч-обработка. То, что сейчас делает Cloudera, их новая технология, связано с тем, чтобы обрабатывать данные в реальном времени и делать запросы к ним. Они оставляют Hadoop как файловую надежную систему, но собирают парадигму map reduce.

Сергей Абрамов: Впечатления. Во-первых, приятно узнать, что ты всю жизнь говорил прозой. Во-вторых, big data – это огромная область, и то, что произошло, что обсуждалось в первом докладе, - это снятие первых результатов в очень легкой пародии. Там, где их было легко и просто снять. Область намного богаче. Я думаю, что 90% проблем с большими данными не решаются этими технологиями. На самом деле, прозвучало несколько подходов: map reduce, потоковый подход, третий связан с дорогими, но эффективными способами хранения. Я думаю, что технологий будет больше. Важно, что проблема обозначена, но нет панацеи. Обозначены несколько точек роста, но, на самом деле, проблем и подходов будет больше. Еще интересен самый первый график из первого доклада, что мы находимся рядом с вершиной, надо успеть, чтобы поучаствовать. Все будет, когда снимутся первые очевидные сливки: map reduce, потоки. Невозможна, если мы говорим про разнородные данные, работа map reduce. Если мы говорим про мама грид, то сначала надо свести разнородные куски, чтобы потом получить возможность абсолютно параллельно их прорабатывать.

Вячеслав Нестеров: Не все задачи big data сводятся к разнородным данным. Иногда это однородные данные.

Игорь Рубенович Агамирзян: Если можно, я добавлю. На самом деле, надо понимать, что если данные потоковые, а у нас очень большой объем таких данных сегодня, то там есть еще одна такая специфическая вещь, как время. Синхронизация для обеспечения сравнимости. А это, кстати говоря, может приводить в больших масштабах к определенным проблемам. Это первое. Второе, я совершенно согласен с тем, что есть некая поляна, и в ней еще не определены фокусные точки. Вообще-то, все относительно. Когда начинается разговор о реальном времени, не могу не вспомнить анекдот, лично со мной произошедший. Еще в советские времена у меня был программистский кооператив, и ко мне пришли люди на тему автоматизации из мелиораторов. Они долго нам рассказывали про сложные задачи управления оборудованием, а потом они сказали, что все это должно происходить в реальном времени. Меня дернуло спросить, какие у них ограничения по времени. Они и сказали «часов 12», у них свое реальное время. На самом деле, это тоже задача реального времени, но она совсем другая. Поэтому просто так на этой оси есть некое положение. Практика бизнес-развития разных технологий показывает, что на этом поле возможностей всегда есть одна или несколько потенциальных ям, куда все и сваливается, где будет точка прорыва, наиболее эффективные приложения. У меня такое ощущение, что в области, связанной с big data, топология этого поля, нахождение этих потенциальных ям на данный момент пока еще не определено. И это, наверное, как раз и есть главная задача с точки зрения того, куда наука будет двигаться дальше.

Сергей Карелов: Я хотел добавить три момента, которые так или иначе звучали, но стоило бы на них особо обратить внимание. Момент первый – все-таки , что такое big data. Говорилось про то, что это 3 V – объем, скорость, вариабельность данных. На самом деле, это всего лишь данность. Очень много данных набирается в мире, в индустрии и бизнесе. Этих данных стало так много, что возникла мысль делать с ними нечто иное, чем делали до того. На самом деле, big data – это не эволюционное развитие процессов быстрой обработки информации. Фишка заключается в том, что это новая парадигма обработки информации, IT. Если раньше до big data была задача, которую надо решить, надо делать алгоритмы, которые ее будут решать, надо искать данные, то здесь меняется сама парадигма. Данных так много, и они настолько разнообразны, что там черт знает что лежит. Можно найти тот самый стратегический инсайд и процесс принятия решений. К сожалению, это очень мало звучало. Но на самом деле, вся история big data - для принятия решений на новом качественном уровне на основании той информации, тех знаний. Здесь big data появилась как новая парадигма. Нет рынка big data. Все спекуляции по поводу того, что сейчас 28 миллиардов, потом 53 миллиарда – нет такого рынка, для которого появилось много данных, и появились инструменты. Инструменты, из которых Hadoop – вообще 0,5-1%. А инструментов же море! На самом деле, фишка в той самой аналитике, которая позволит вынуть стратегический инсайд и процесс принятия решений. Сейчас сошлись на том, что к 2020 году не будет понятия big data вообще. Потому что все будет big data. Это перейдет в новую парадигму, а старая вообще уйдет. Существует две проблемы. Первая, про которую мы говорили, но она заслуживает того, чтобы быть повторенной еще раз. Все упирается в людей. Big data – это люди. Если нет вертикальной профессиональной экспертизы, если нет бизнес-кейса, забудьте про big data. Суперкомпьютеры вообще из другой области, тут нет проблемы суперкомпьютеров. Тут есть проблема, что нет людей, нет тех самых аналитиков, и нет бизнес-кейсов. Если вы посмотрите на халф-цикл big data, то вы обнаружите, что он состоит не только из технологий. Еще из новых бизнес-кейсов, из новых источников и способов работы с информацией. Именно в этом и будет прорыв. Последняя проблема. Дело в том, что свалить много параллельно распределенной информации и абсолютно разнородной информации – уже сейчас это кое-как решают. Никак не могут решить проблему, каким образом эти данные разнородного формата затачивать под один бизнес-кейс. Упоминалась компания Palantin. На самом деле, это, пожалуй, единственная на сегодняшний день компания, которая научилась это делать. Научилась сливать потоки информации, идущие от обработки кредитных карточек, от отпечатков пальцев, от операций с транспортом, из health care. Но их живенько погребли, и около 90% они сейчас работают исключительно на Пентагон и ЦРУ. А эта задача – super challenge для big data, потому что еще раз big data – это не big data, а big money. И это даже не те технологии, о которых идет речь. Как суметь вынуть стратегический инсайд, перевести процесс принятия решений на совершенно другой уровень. Но это находится в самом младенчестве. Говорить о том, что состояние big data есть, - никакого нет, только начали. На эту парадигму надо переходить. К 2020 году обещают начать переходить.

Сергей Кербер: В продолжение последнего комментария. Хотел задать вопрос собственно бизнесу. У меня возникал тот же вопрос. Коллеги, а как вы это продаете? Вы сегодня говорите, что у вас 1% продаж – big data. Как вы ее продаете? Если вы продаете серверы, понятно, все пользователи знают, что им нужны серверы. И кто к кому приходит, с чем приходит, какие есть стандартные решения.

Игорь Рубенович Агамирзян: Можно на правах модератора и человека с 15 годами опыта работы в multinational отвечу сначала я? Потому что я не связан корпоративной политкорректностью. Мое представление о том, почему это стало интересно крупным корпорациям. Исключительно по одной интересной логике. Если есть что-то такое, что ты не можешь предотвратить, то единственный способ правильно себя вести – это возглавить.

Леонид Жуков: Я могу привести пример не о продаже, а о покупке. В компании, где я сейчас консультирую, есть следующая ситуация: 11 петабайт данных хранятся в обычных SQL базах под Microsoft-серверами. Microsoft решил изменить политику и брать деньги не за процессор, а за ядро. Неожиданно компания залетает, ну очень сильно. Компания дальше говорит «нет, так дело не пойдет, давайте искать варианты», приходят Cloudera и все эти ребята и говорят «не вопрос, в 50 раз дешевле».

Сергей Абрамов: Было сказано, что подходы были не для Oracle. Oracle пришли не для big data.

Игорь Рубенович Агамирзян: Это было бы очень странно, если бы это было не так.

Леонид Жуков: EMC и IBM тоже очень хорошо с Hadoopом работают.

Сергей Лихарев: Есть хороший пример с ветряками. Чтобы ткнуть в место на карте, где ветряк будет установлен (а это огромные инвестиции), они анализируют погоду в этой точке, кучу всякой информации. Их единственная задача – выбрать место. Они пробовали решить эту задачу разными способами, они не могут сопоставить данные и в разумное время обработать без big data. Хотя вопрос в несколько месяцев, не лет. Нужно быстрее, заказчики требуют быстрых решений. Другие примеры, любой банк. Информации о заказчиках много, а вот почему они это делают, в чем причина – непонятно. Давайте проанализируем, что они пишут о нас, о наших конкурентах, почему они это делают. Это продается, когда мы можем объяснить, как из новых данных или обработки большого объема в конце получатся деньги - либо меньше затрат.

Вопрос из зала: В первую очередь, как я понимаю, все равно клиент приходит к вам с проблемой?

Сергей Лихарев: В этом случае не так, на самом деле. Вот то, что сейчас происходит. Часто клиент, наслушавшись этого всего, говорит: «Помогите мне, объясните, что такое big data и где возможные области применения». Мы приходим и рассказываем, а дальше они начинают думать, или мы вместе с ними. Есть возможность говорить про стриминг, быструю обработку больших объемов разнородных данных. У клиента есть математика в голове, но он пока не может это поддержать и просит рассказать о технологиях.

Я говорил про это, компания TerraEchos в Америке защищает периметры. Они анализируют звук, прокладывают оптоволоконный кабель по периметру объекта. В конце они могут сказать, что сейчас идет человек, вот это пробежала собака. Просто анализируя изменения. Они используют нашу обработку, принимают решение и разрабатывают его.

Вячеслав Нестеров: Я, конечно, ничего не продаю. Но насколько я знаю, как проходят продажи. Есть инженеры, data-аналитики, они снабжены необходимыми средствами и пониманием, как это надо делать. Потом эти люди идут к заказчику, вникают в его бизнес, довольно много там проводят времени - и предлагают свое решение.

Игорь Рубенович Агамирзян: Тогда у меня вопрос. От IBM и EMC прозвучало то, что это direct sales проекты. До сих пор не появилось перепродажников?

Сергей Лихарев: Почему? На самом деле, это тенденция… Партнеры тоже видят этот рынок. И они говорят о том, что хотят создать центр компетенций big data, например, по энергетике. Будем искать кейсы и предлагать решения, потому что, в конце концов, абстрактный Hadoop никому не нужен. Hadoop направлен на обработку определенных данных, чтобы получить определенную ценность. Идет процесс, когда интеграторы выбирают, как играть.

Александр Брызгалов: У меня короткий вопрос. А можно пустить всю интеллектуальную мощь big data на прозаический процесс, идеальный подбор мужчин и женщин? Это решит все.

Леонид Жуков: Это называется алгоритм marriage. В Америке так работают алгоритмы для людей, закончивших институты, по подбору госпиталей, где они будут проходить ординатуру. Госпиталя выбирают, кого они хотят принять, а студенты дают выбор из нескольких госпиталей, где бы они хотели работать и дальше учиться. Дальше проверяются разные комбинации и делается выбор. Это оптимальный подбор персонала, и он работает уже, наверное, лет 20.